Быстрая нейросеть без дорогой видеокарты: состоялся релиз гибридной LFM2-24B-A2B

Содержание

Не знаете, какой ПК взять?

Ответьте на несколько вопросов — получите готовую сборку с ценой.

Разработчики из Liquid AI продолжают радовать энтузиастов локального искусственного интеллекта. Они выложили в открытый доступ раннюю версию своей самой крупной нейросети — LFM2-24B-A2B. Новинка использует гибридную архитектуру и работает невероятно быстро даже на обычных потребительских компьютерах без мощных дискретных видеокарт.

Краткое содержание

- Разработчики открыли доступ к новой ИИ-модели LFM2-24B-A2B на платформе Hugging Face;

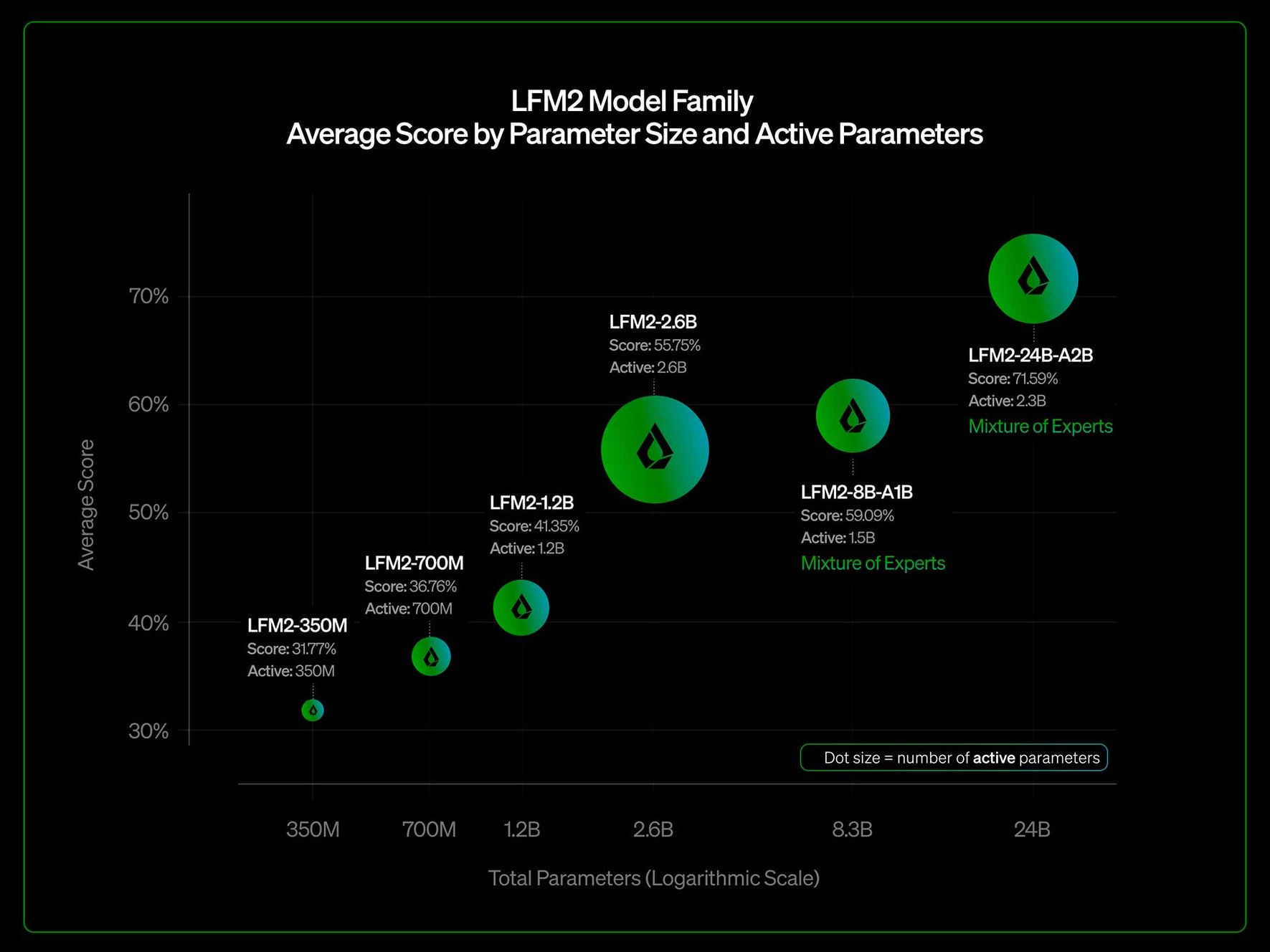

- Нейросеть содержит 24 млрд параметров, но при генерации каждого токена активирует всего около двух миллиардов;

- Для запуска модели на домашнем компьютере вполне хватит 32 ГБ обычной оперативной памяти;

- Архитектура объединяет свёрточные блоки и классический механизм внимания для максимального ускорения работы.

Гибридный подход к нейросетям

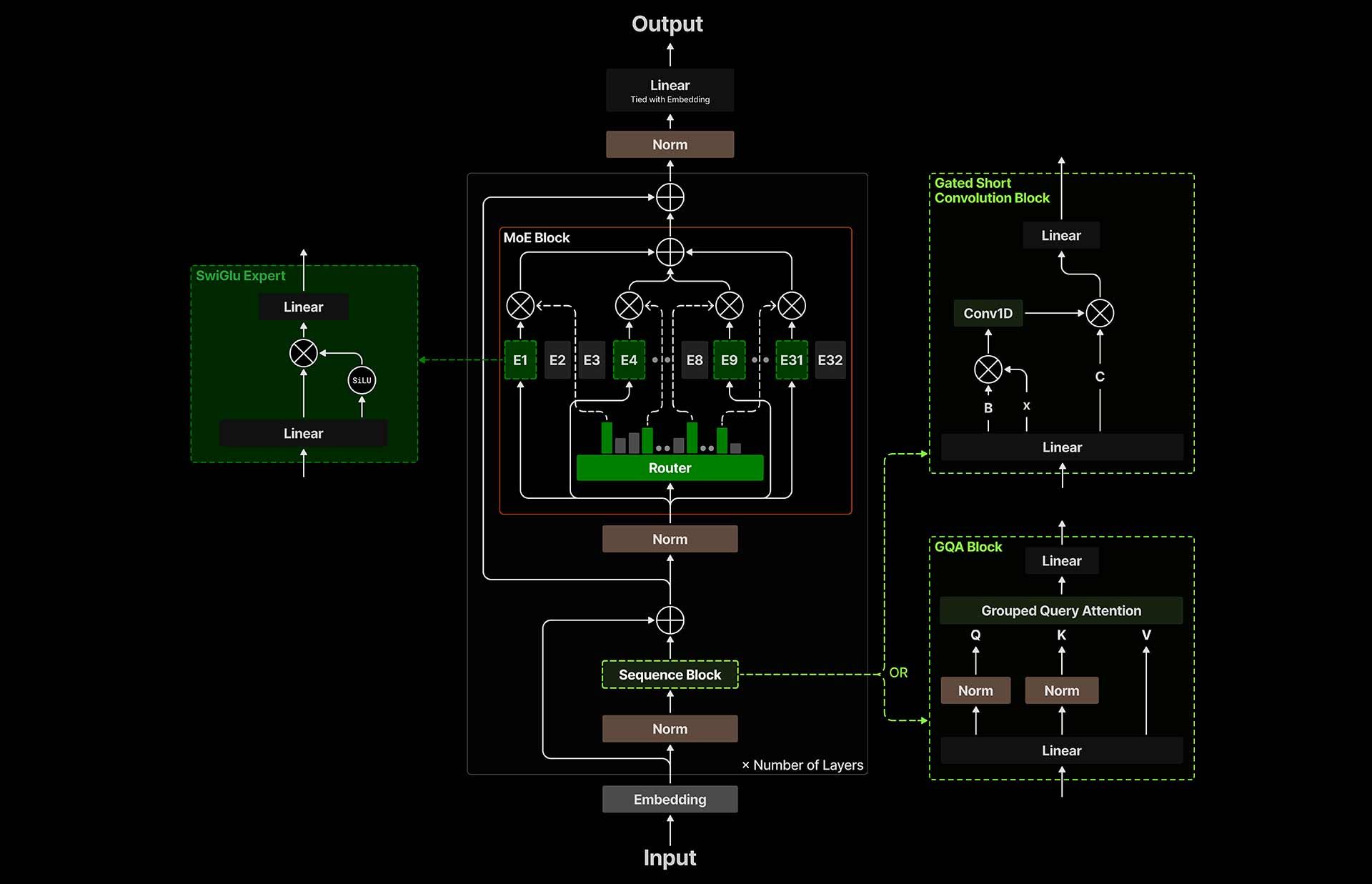

Секрет успеха LFM2 кроется в её необычном строении. Инженеры компании объединили два разных подхода. Основную часть работы берут на себя эффективные свёрточные блоки, а классический механизм внимания (GQA) включается только на определённых этапах. Благодаря этому модель выдаёт текст с огромной скоростью и потребляет минимум ресурсов системы.

Новинка развивает идеи предыдущей версии на 8 млрд параметров. Разработчики увеличили глубину сети с 24 до 40 слоёв и удвоили количество так называемых «экспертов» в каждом блоке — с 32 до 64. При этом они сохранили строгий механизм активации: во время работы запускаются только четыре самых подходящих эксперта. Именно поэтому из общих 24 млрд параметров в конкретный момент времени работают лишь 2,3 млрд. Это позволяет запускать столь умную модель даже на интегрированной графике ноутбука или встроенном в процессор нейронном блоке (NPU).

Рекордная скорость генерации

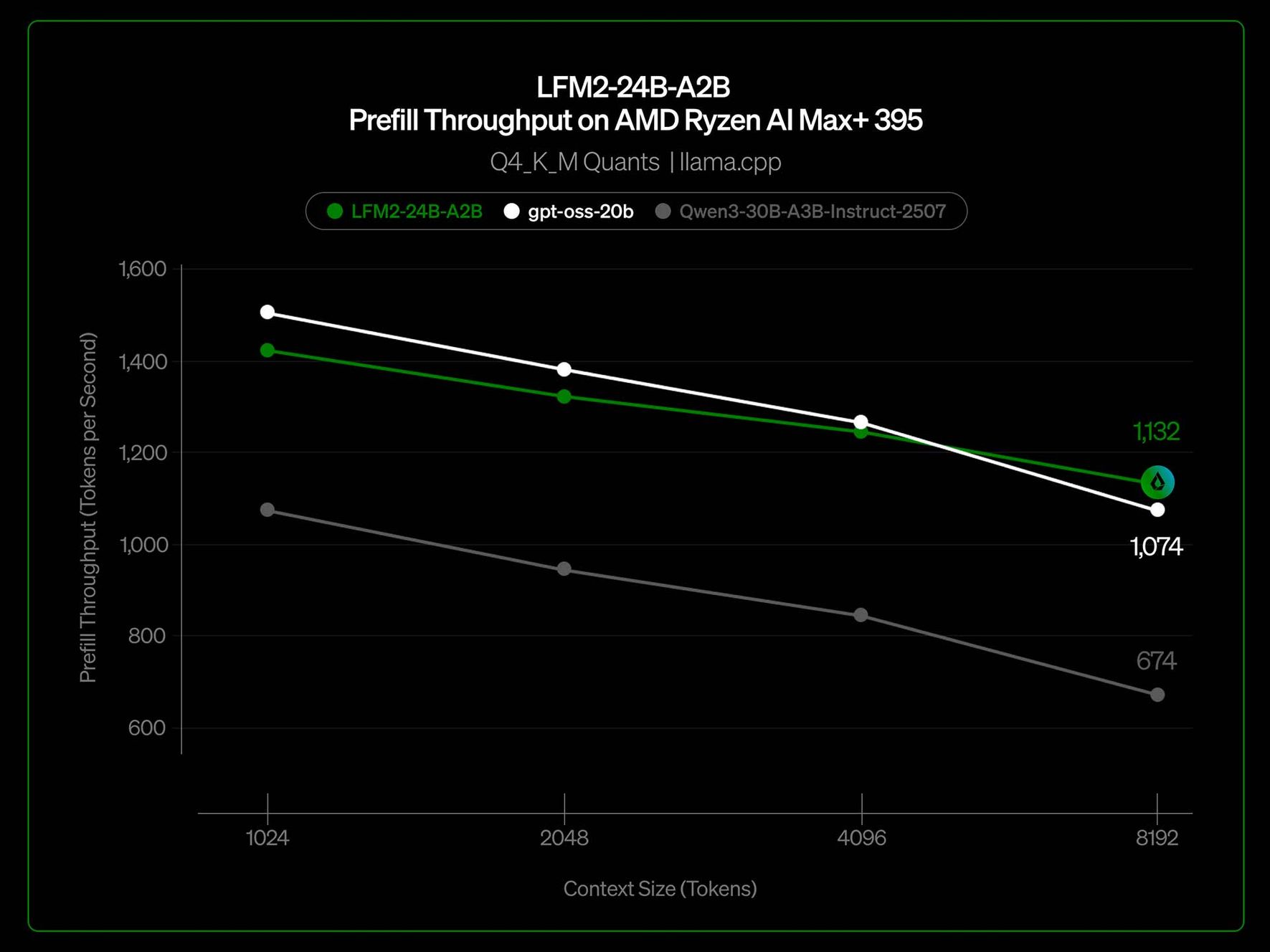

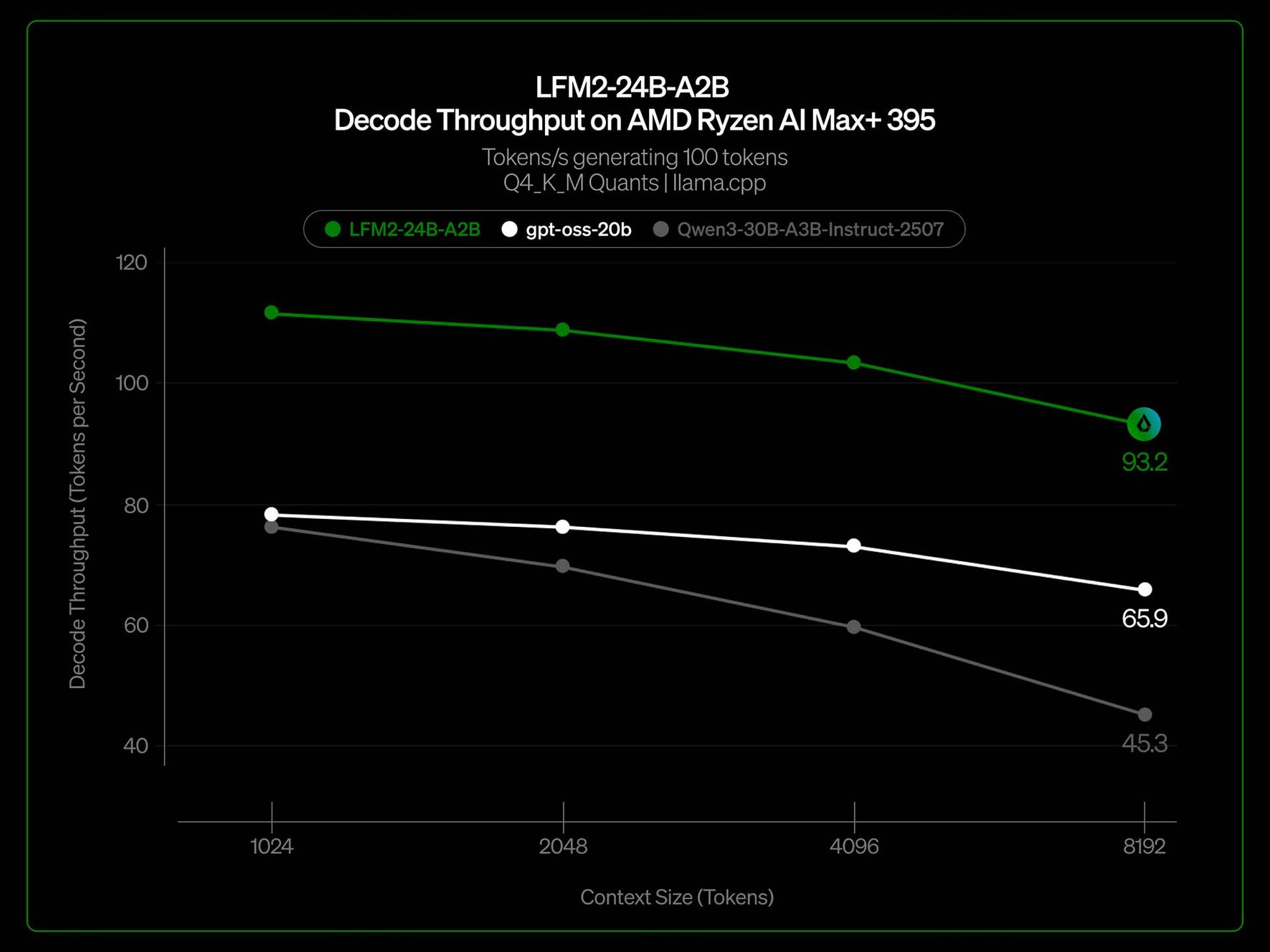

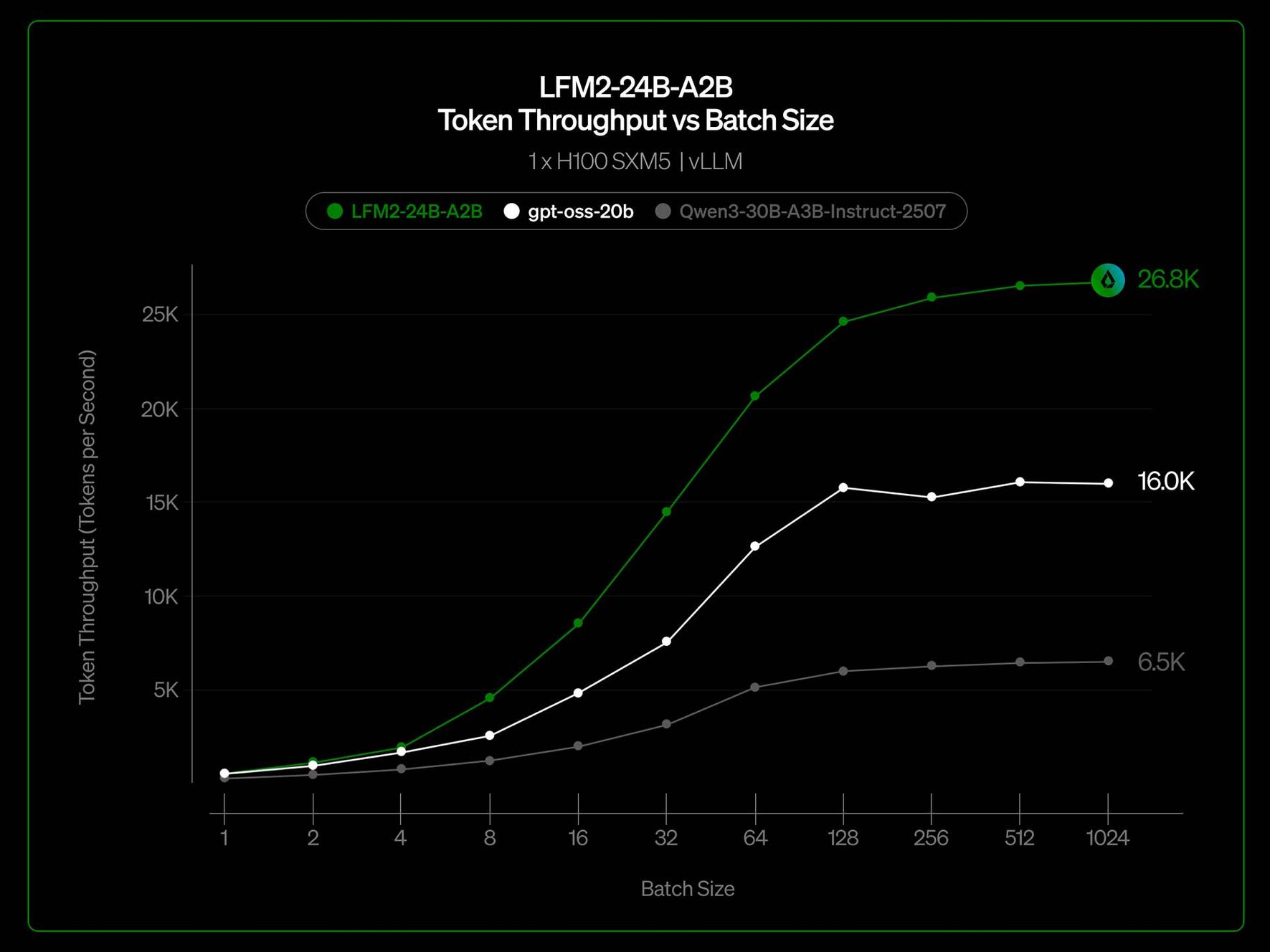

Создатели модели сразу подготовили её к работе во всех популярных оболочках. Нейросеть поддерживает форматы GGUF и отлично работает через llama.cpp, vLLM и SGLang. Ты можешь запускать её прямо на центральном процессоре. Во внутренних тестах компании новая LFM2 легко обходит конкурентов вроде Qwen3 и gpt-oss по скорости выдачи токенов, особенно при работе с большими объёмами текста.

Если ты хочешь плотно заняться изучением локальных нейросетей и машинным обучением, тебе всё же понадобится серьёзное железо. Постоянно гонять тяжёлые модели на слабом процессоре — сомнительное удовольствие. Наши рабочие станции для ИИ отлично подходят для подобных задач. Мы собираем их из самых надёжных комплектующих, чтобы система работала стабильно даже при круглосуточных нагрузках.

Что ждёт нас дальше

Сейчас инженеры Liquid AI продолжают активно обучать эту модель. Она уже поглотила 17 триллионов токенов информации, и процесс не останавливается. В будущем разработчики планируют выпустить финальную версию LFM2.5, которая пройдёт дополнительную настройку и покажет ещё более впечатляющие результаты в тестах логики и математики.

А пока ты можешь свободно скачать текущие веса модели и проверить её возможности на своём компьютере. Заходи в наш конфигуратор ПК и собирай систему с большим объёмом оперативной памяти, чтобы легко запускать подобные нейросети у себя дома, а мы гарантируем идеальное качество сборки.

Не пропусти главное в мире ПК

Мы публикуем последние новости из компьютерного мира. Подписывайся, чтобы быть в курсе и ничего не пропустить.