Релиз Mamba-3: новая ИИ-модель с уникальной архитектурой для быстрого инференса

Содержание

Не знаете, какой ПК взять?

Ответьте на несколько вопросов — получите готовую сборку с ценой.

Команда Together AI совместно с ведущими научными институтами официально представила новую языковую модель Mamba-3. Предыдущая версия системы делала упор на ускорение процесса обучения, но теперь фокус полностью сместился на максимальную скорость генерации текста. Новая архитектура класса SSM обходит популярные решения и классические трансформеры по скорости работы при сохранении невероятно высокого качества ответов.

Краткое содержание

- Состоялся релиз новой языковой модели Mamba-3 от команды Together AI;

- Главной целью проекта стало ускорение инференса и снижение задержек при генерации;

- Модель получила уникальную архитектуру с поддержкой комплексных чисел и технологии MIMO;

- Новинка обходит классические трансформеры по скорости работы на любых длинах контекста;

- Команда проекта выложила исходный код ядер в открытый доступ для всех желающих.

Ограничения линейных моделей и фокус на инференс

Современный рынок искусственного интеллекта диктует новые правила. Компании массово внедряют агентивные рабочие процессы, которые постоянно генерируют огромные объёмы текста для решения сложных многоступенчатых задач. Поэтому сейчас скорость выдачи готовых ответов играет более важную роль, чем скорость первоначального обучения алгоритмов на серверах. Команда Together AI приняла этот вызов и переработала внутреннюю структуру системы, чтобы обеспечить по-настоящему молниеносный инференс.

Главное преимущество линейных моделей кроется в их названии: вычислительные затраты масштабируются линейно по мере роста длины контекста. Это происходит благодаря фиксированному размеру состояния. Классический трансформер, наоборот, постоянно увеличивает потребление памяти из-за бесконечного роста кэша ключей и значений (KV-кэш). Трансформер запоминает всю прошлую информацию, а модель класса SSM вынуждена сжимать все прошлые данные в одно фиксированное представление. Чтобы заставить этот небольшой фиксированный объём памяти работать эффективнее, команде пришлось серьёзно усложнить внутреннюю математику процесса.

Три главных архитектурных изменения

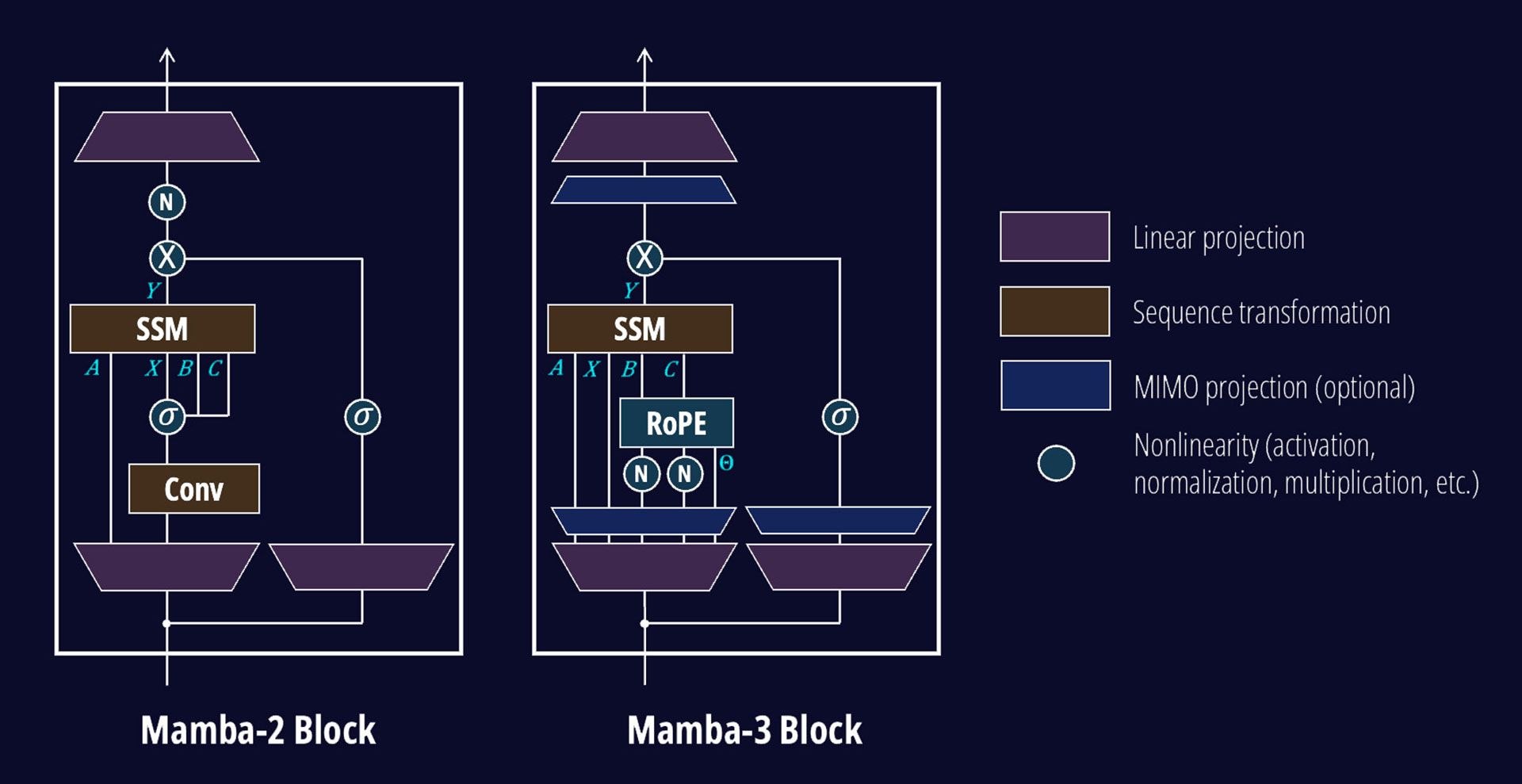

Чтобы добиться превосходства над конкурентами, новая архитектура получила три ключевых изменения в базовой структуре. Во-первых, формула рекуррентности стала гораздо сложнее и выразительнее. Это позволило модели лучше улавливать контекст и взаимосвязи слов. Во-вторых, система научилась отслеживать состояния с помощью комплексных чисел, что значительно расширило её математические возможности.

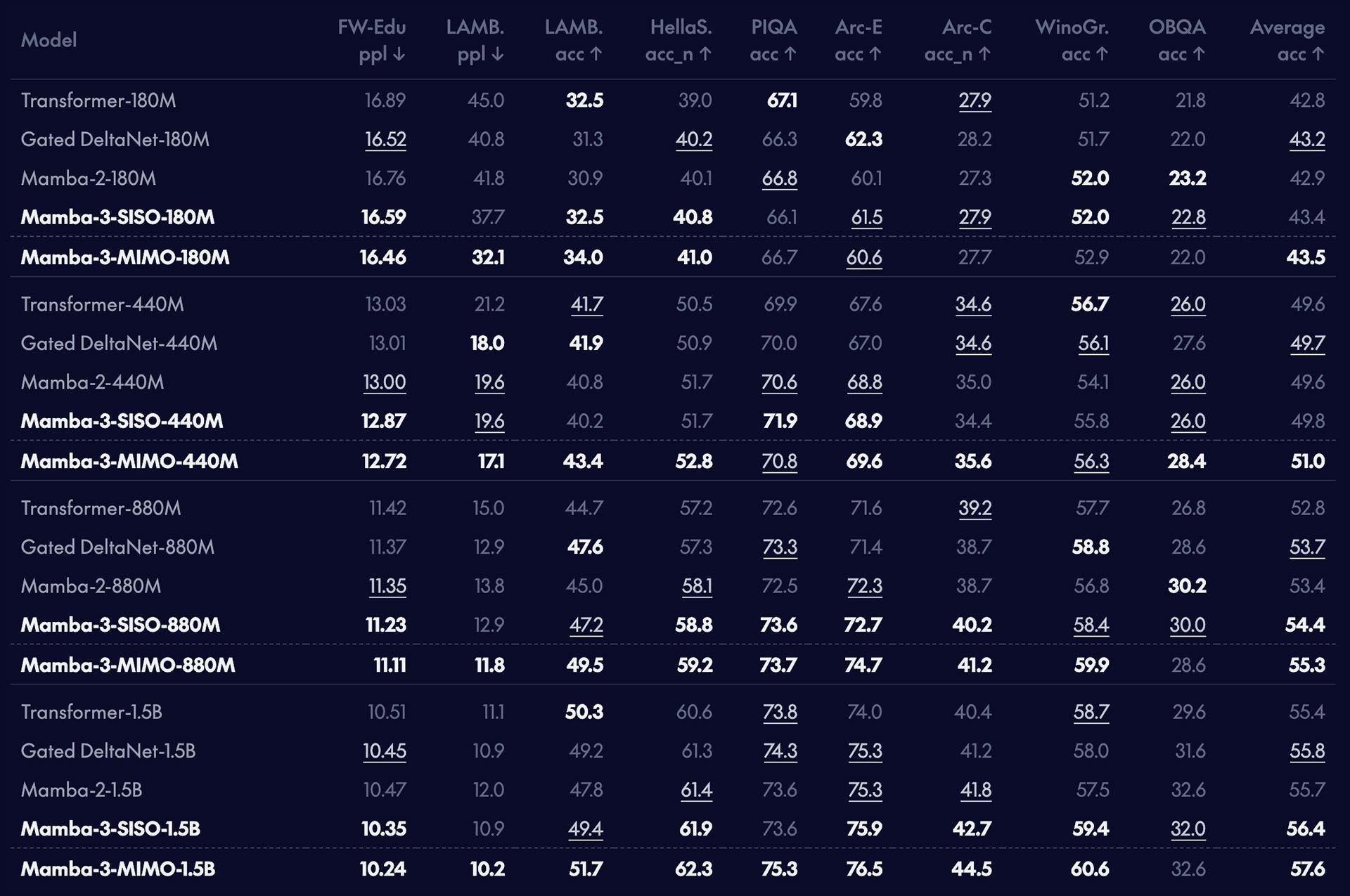

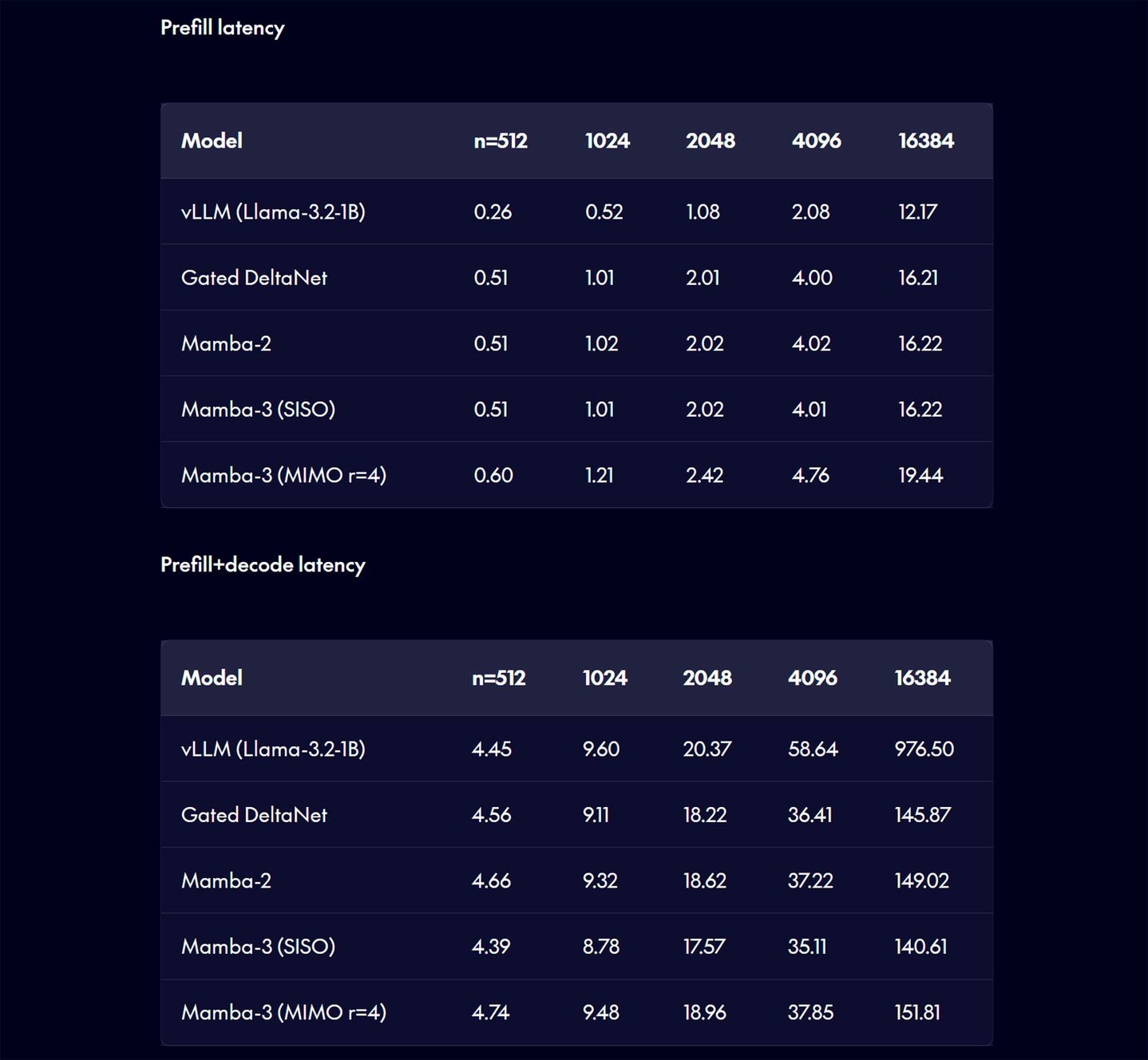

В-третьих, появилась продвинутая экспериментальная версия с поддержкой технологии MIMO. Этот подход позволяет нейросети обрабатывать сразу несколько потоков данных параллельно внутри одного слоя. Такая инновация значительно повышает точность ответов без какого-либо ущерба для скорости генерации. Во время тестов версия Mamba-3 с параметром SISO уверенно обошла прошлую модель Mamba-2, популярную сеть Gated DeltaNet и даже классический трансформер Llama-3.2-1B по скорости обработки промптов и выдачи текста на всех длинах контекста при размере в 1,5 миллиарда параметров.

Отказ от коротких свёрток и гибридное будущее

Архитектура претерпела и другие важные изменения. Команда отказалась от классических коротких свёрток, которые активно использовались в прошлых версиях линейных алгоритмов. Вместо этого в систему добавили новые модули нормализации QKNorm, которые отлично стабилизируют работу всей платформы во время обучения. Также модель получила обновлённые компоненты RoPE для более эффективной работы с комплексными числами.

Несмотря на все улучшения, линейные модели с фиксированным состоянием физически уступают классическим трансформерам в задачах точного поиска информации по тексту. Трансформер просто извлекает точную цитату из своего огромного кэша, а линейная модель пытается вспомнить данные из сжатого состояния. Поэтому будущее индустрии явно в создании гибридных моделей, где молниеносные слои Mamba-3 будут работать в паре с точными слоями классического механизма внимания.

Открытый исходный код и оптимизация ядер

Команда проекта открыто делится своими наработками с сообществом. Исходный код ядер, которые написали с использованием передовых инструментов Triton, TileLang и CuTe DSL, уже лежит в публичном доступе. Такой глубокий подход к программированию на низком уровне позволил выжать максимум производительности из современных графических ускорителей архитектуры Hopper. Любой желающий энтузиаст может скачать эти быстрые ядра и использовать их для запуска собственных локальных нейросетей.

Обучение агентивного ИИ требует колоссальных ресурсов, но далеко не всегда безопасно доверять важные данные сторонним облачным сервисам. Если твоему проекту нужна надёжная и независимая инфраструктура, заказывай сборку кастомных GPU-серверов от компании DigitalRazor. Мы создаём бескомпромиссные вычислительные узлы на базе актуальных графических чипов.

Не пропусти главное в мире ПК

Мы публикуем последние новости из компьютерного мира. Подписывайся, чтобы быть в курсе и ничего не пропустить.