Что такое LM Studio и зачем он нужен: полный гайд по локальному инференсу с GUI, API и RAG в 2026 году

/files/upload/iblock/a55/a555a2fe1beba3c539a33c23853b79fc.png)

Подберём игровой ПК за 2 шага

Ответьте на несколько вопросов — покажем готовые сборки

Сфера искусственного интеллекта кардинально изменилась. В 2026 году стало абсолютно нормальным запускать нейросети прямо на домашних компьютерах или рабочих серверах, а не только через облачные сервисы. В этом руководстве мы простым языком рассказываем, как самостоятельно установить, настроить и использовать одну из лучших платформ для работы с локальными генеративными моделями.

Что такое LM Studio

Ответить на вопрос, что такое LM Studio, можно очень просто: это удобная программа, которая прячет под капотом весь сложный код и предоставляет пользователю понятный графический интерфейс для управления языковыми моделями.

Внутри программы работают быстрые движки: llama.cpp для обычных процессоров x86 или ARM и фреймворк MLX, который заставляет нейросети летать на чипах Apple Silicon. Приложение превращает обычный ПК в умную когнитивную станцию. Программа объединяет окно чата, поиск моделей в базе Hugging Face, локальный сервер и удобные инструменты для работы с документами. Инструмент позволяет легко запускать нейросети людям без навыков программирования.

Почему стоит использовать локальные LLM

Строгие требования безопасности и экономия бюджета заставляют бизнес переносить работу из облака на локальные языковые модели.

Преимущества:

- Приватность и конфиденциальность данных. Главная причина выбора локального запуска. При анализе финансов, проверке программного кода или работе с медицинскими картами правила запрещают передавать данные в Сеть. Работа на собственных мощностях гарантирует, что информация останется на рабочем компьютере и не попадёт в чужие руки;

- Работа без интернета (офлайн). Скачанные модели работают сами по себе. Офлайн-формат позволяет решать задачи в местах с плохой связью или внутри закрытых корпоративных сетей;

- Отсутствие цензуры и ограничений. Облачные сервисы часто отказываются отвечать на сложные вопросы из-за жёстких фильтров. Модели на домашнем ПК или рабочей станции дают полный доступ к знаниям без каких-либо ограничений;

- Бесплатность (нет подписок). Облачные компании берут деньги за каждый сгенерированный токен. Отличная бесплатная альтернатива СhatGPT не требует подписок, а бюджет нужен лишь на единоразовую покупку железа;

- Контроль над моделью. Облачные сервисы периодически обновляют систему, из-за чего настроенные задачи ломаются. Локальные файлы всегда работают одинаково;

- Интеграция в проекты. Локальный чат легко встраивать в рабочие программы.

Недостатки:

- Требования к железу. Производительность жёстко упирается в объём видеопамяти (VRAM).

- Ограниченная производительность. Скорость работы будет ниже, чем на мощных облачных серверах;

- Нет доступа к интернету у модели. По умолчанию алгоритм не может искать свежие новости в Сети, он знает только заложенную в него при обучении информацию;

- Качество зависит от размера модели. Маленькие версии на 3–8 млрд параметров хуже решают сложные логические задачи, чем огромные модели, которым требуются десятки гигабайт видеопамяти.

Системные требования для работы с LM Studio

Железо выступает главным ограничивающим фактором. Чтобы нейросеть работала, компьютер должен целиком загрузить её в быструю память. Для обычных процессоров важно наличие инструкции AVX2. Платформы Apple Silicon и видеокарты NVIDIA с технологией CUDA обеспечивают наивысшую производительность.

| Размер модели | Требуемая память | Оптимальное железо (2026) | Примеры |

|---|---|---|---|

| До 4B | ~3,5–5 ГБ | ПК с 8 ГБ ОЗУ, видеокарта уровня GTX 1650 | Qwen 3 4B |

| 7B–9B | ~8–10 ГБ | Mac M1, видеокарты RTX 3060 или 4060 | Llama 3.1 8B |

| 12B–35B | ~12–30 ГБ | Mac M4 Max, мощные RTX 4070 Ti или 4090 | Gemma 4 26B |

| 70B–671B | ~45–700 ГБ | Кластеры из нескольких видеокарт, Mac Studio Ultra | DeepSeek-V3 |

Системные требования разных моделей

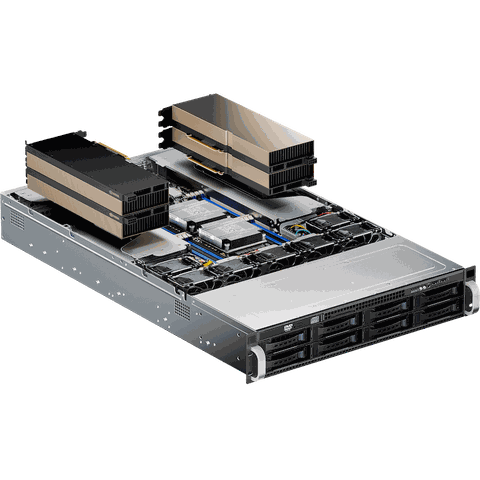

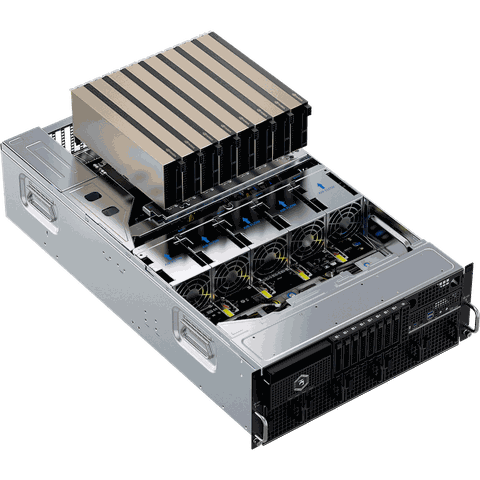

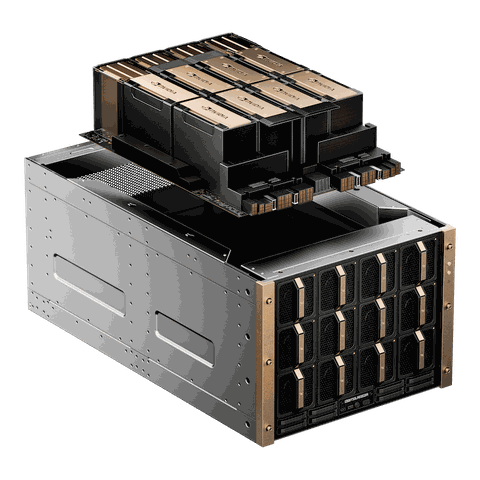

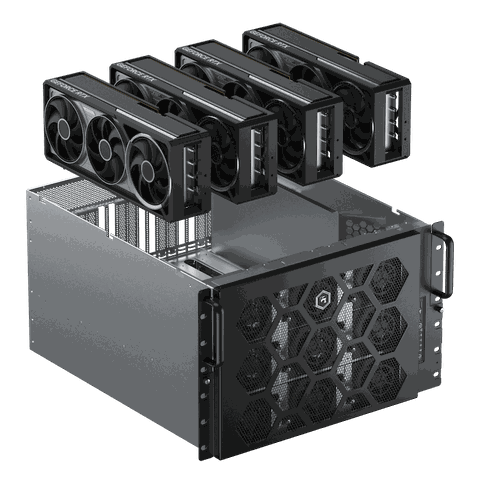

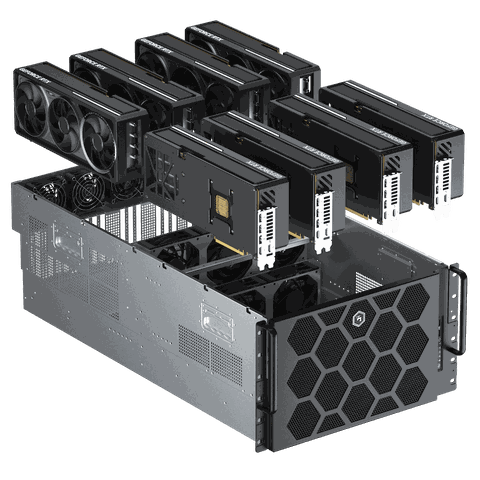

Лёгкие алгоритмы быстро работают на домашних ПК. Но гигантские промышленные модели требуют совершенно другой вычислительной мощи. Чтобы понять, из чего состоит сервер для таких задач, стоит изучить профильные статьи. Под тяжёлые вычисления лучше брать готовые решения из каталога GPU-серверов. Станции с 4–8 видеокартами легко обеспечат работу ИИ без тормозов.

Выберите GPU-сервер для нейросетей

Готовые решения для работы с большими массивами данных

Чтобы заранее понимать, сколько видеопамяти заберёт под себя конкретная нейросеть в зависимости от степени её сжатия, воспользуйся этой таблицей расчётов (значения указаны с учётом обязательного запаса в 20% на генерацию контекста):

| Размер модели | Сжатие Q4 (4 бита) | Сжатие Q8 (8 бит) | FP16 (без сжатия) |

|---|---|---|---|

| 4B (Qwen 3) | ~2,4 ГБ VRAM | ~4,8 ГБ VRAM | ~9,6 ГБ VRAM |

| 8B (Llama 3.1) | ~4,8 ГБ VRAM | ~9,6 ГБ VRAM | ~19,2 ГБ VRAM |

| 14B (Qwen 2.5) | ~8,4 ГБ VRAM | ~16,8 ГБ VRAM | ~33,6 ГБ VRAM |

| 32B (Qwen 3) | ~19,2 ГБ VRAM | ~38,4 ГБ VRAM | ~76,8 ГБ VRAM |

| 35B (Qwen 3.6) | ~21,0 ГБ VRAM | ~42,0 ГБ VRAM | ~84,0 ГБ VRAM |

Как видно из таблицы, популярный и оптимальный формат квантования Q4 позволяет уместить мощную 32-миллиардную модель в видеокарту с 24 ГБ памяти (например, RTX 4090), в то время как её версия без сжатия потребовала бы недостижимые для обычного ПК 76,8 ГБ.

Установка и первый запуск LM Studio

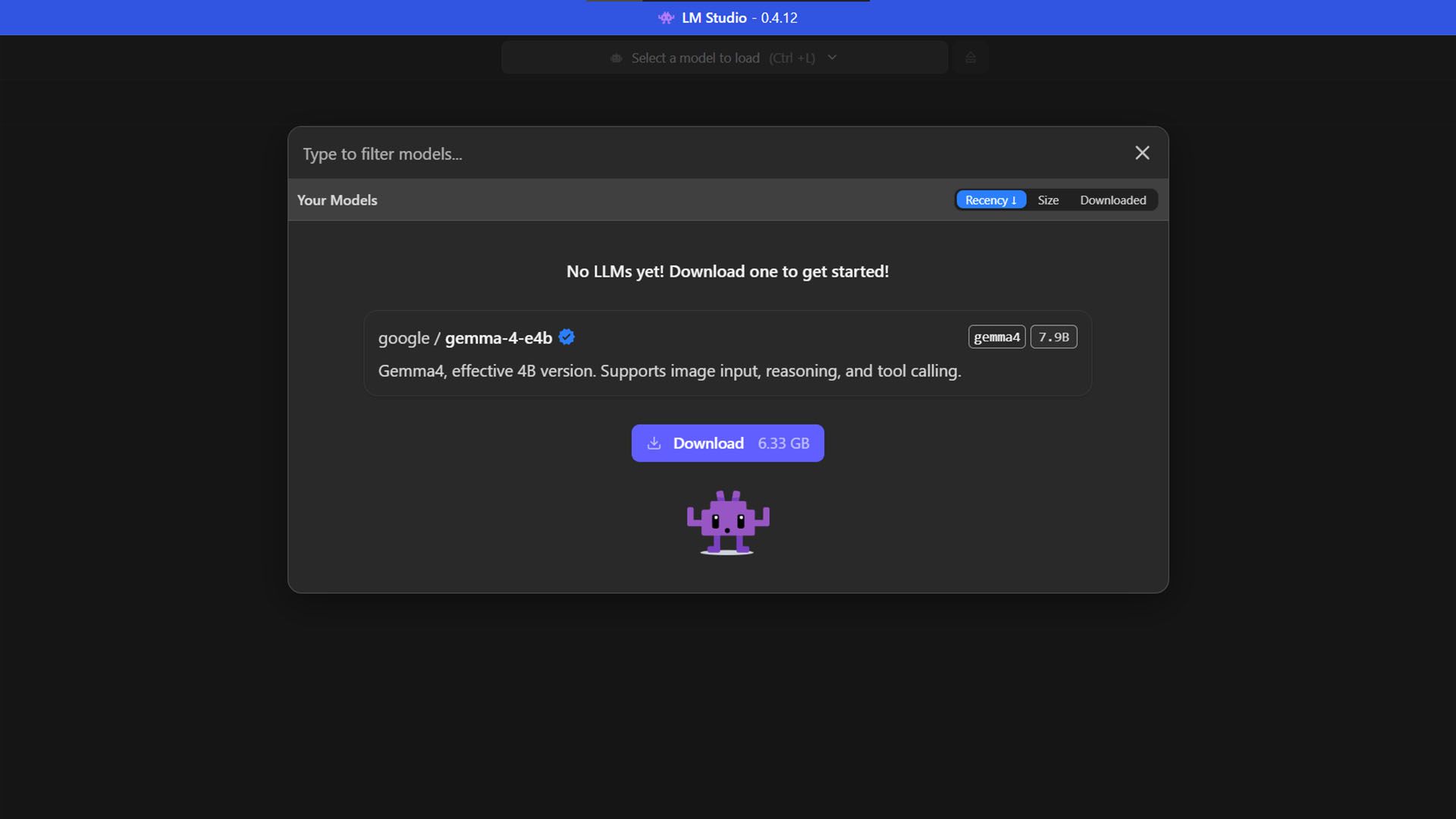

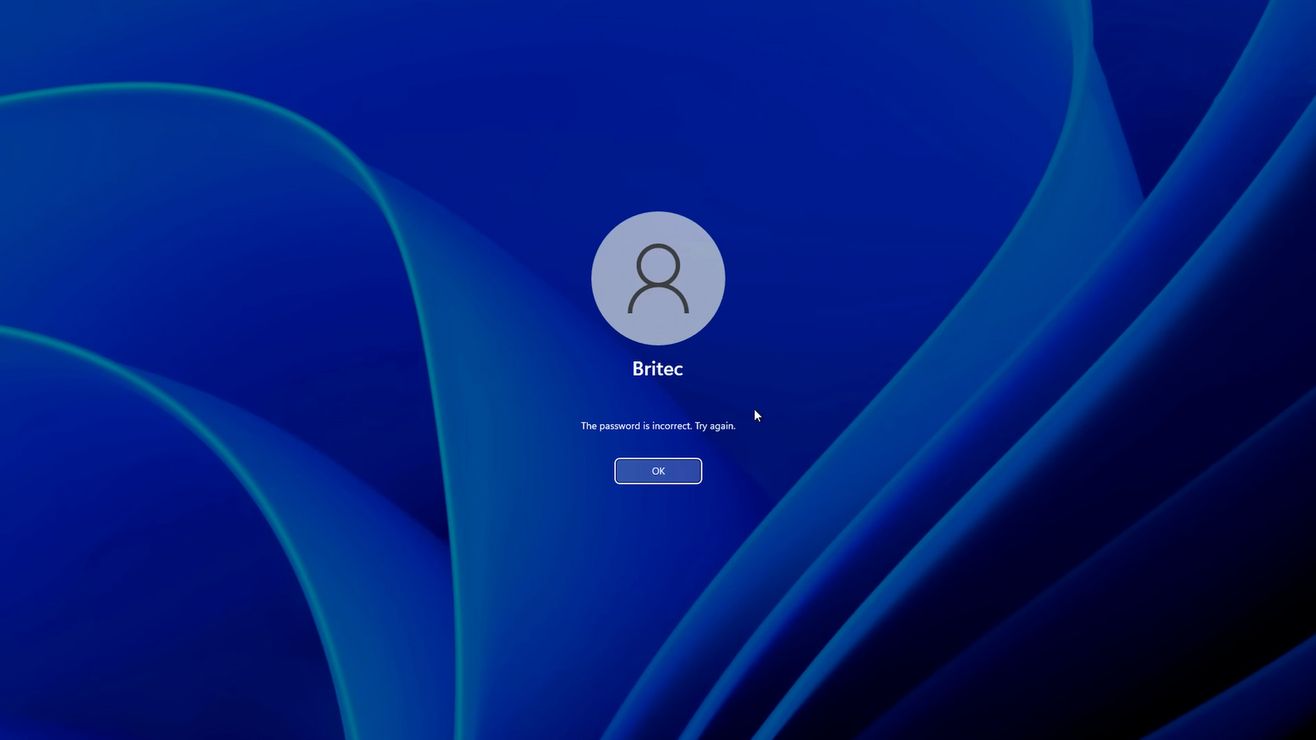

Для запуска программы пользователю не нужно писать код в командной строке. Процесс инсталляции проходит как обычно: нужно скачать файл с сайта (доступны версии для Windows, macOS и Linux) и установить программу.

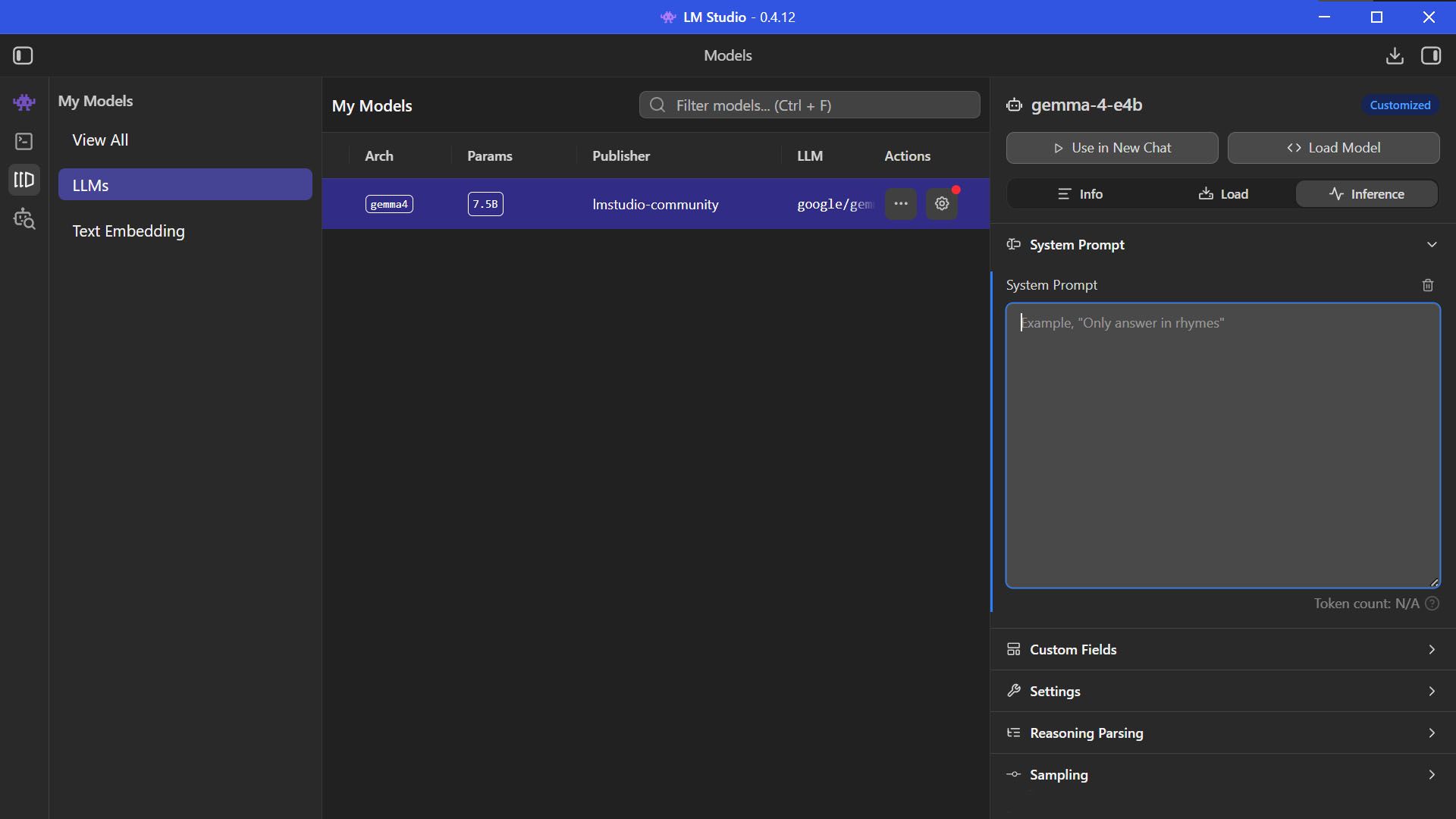

При первом запуске окно будет пустым — разработчики не встраивают модели в дистрибутив, чтобы не тратить место на диске. Нужно зайти в поиск, выбрать нужный файл в формате GGUF и нажать кнопку загрузки. Разработчики также предлагают версию без графического меню llmster для работы на удалённых серверах.

Основные возможности LM Studio

Программа умеет всё: от простых бесед до сложных задач с документами.

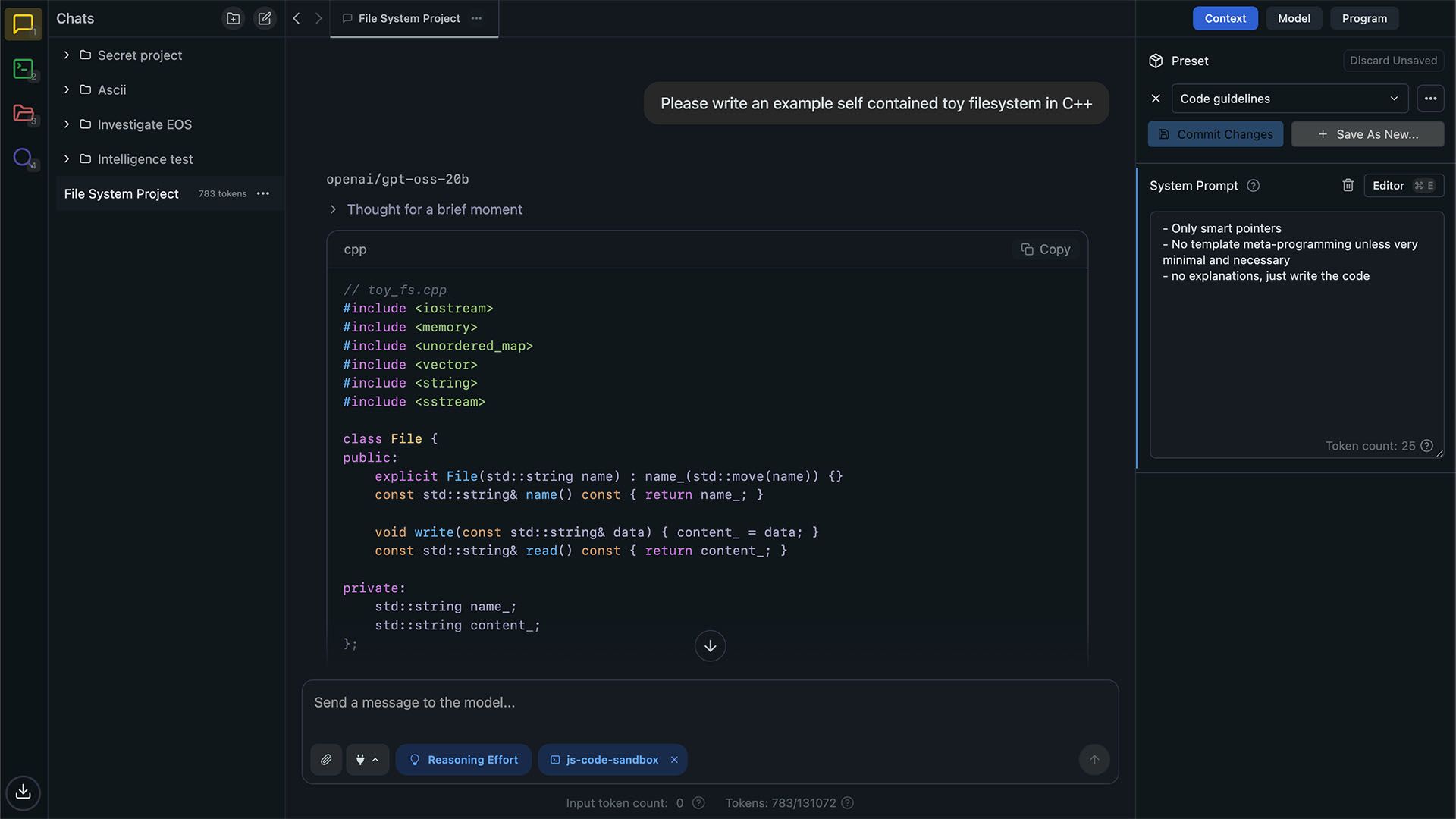

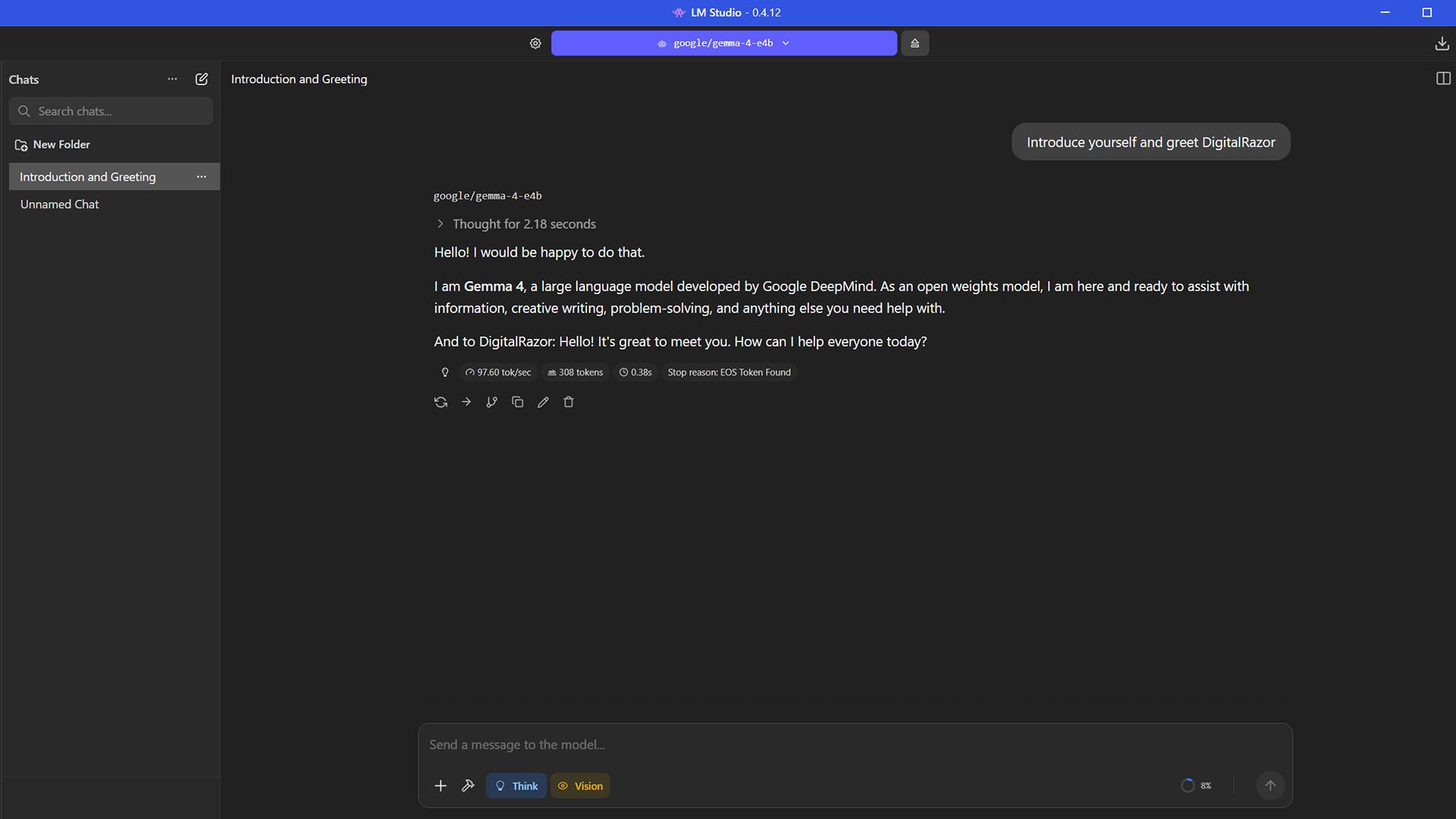

Интерфейс для диалога

Интерфейс выглядит как привычный чат. Но здесь пользователь может менять свои вопросы и ответы нейросети, разветвлять диалог для тестов и навсегда удалять сообщения из памяти. Кнопка перегенерации сохраняет прошлые варианты ответов, позволяя легко переключаться между ними.

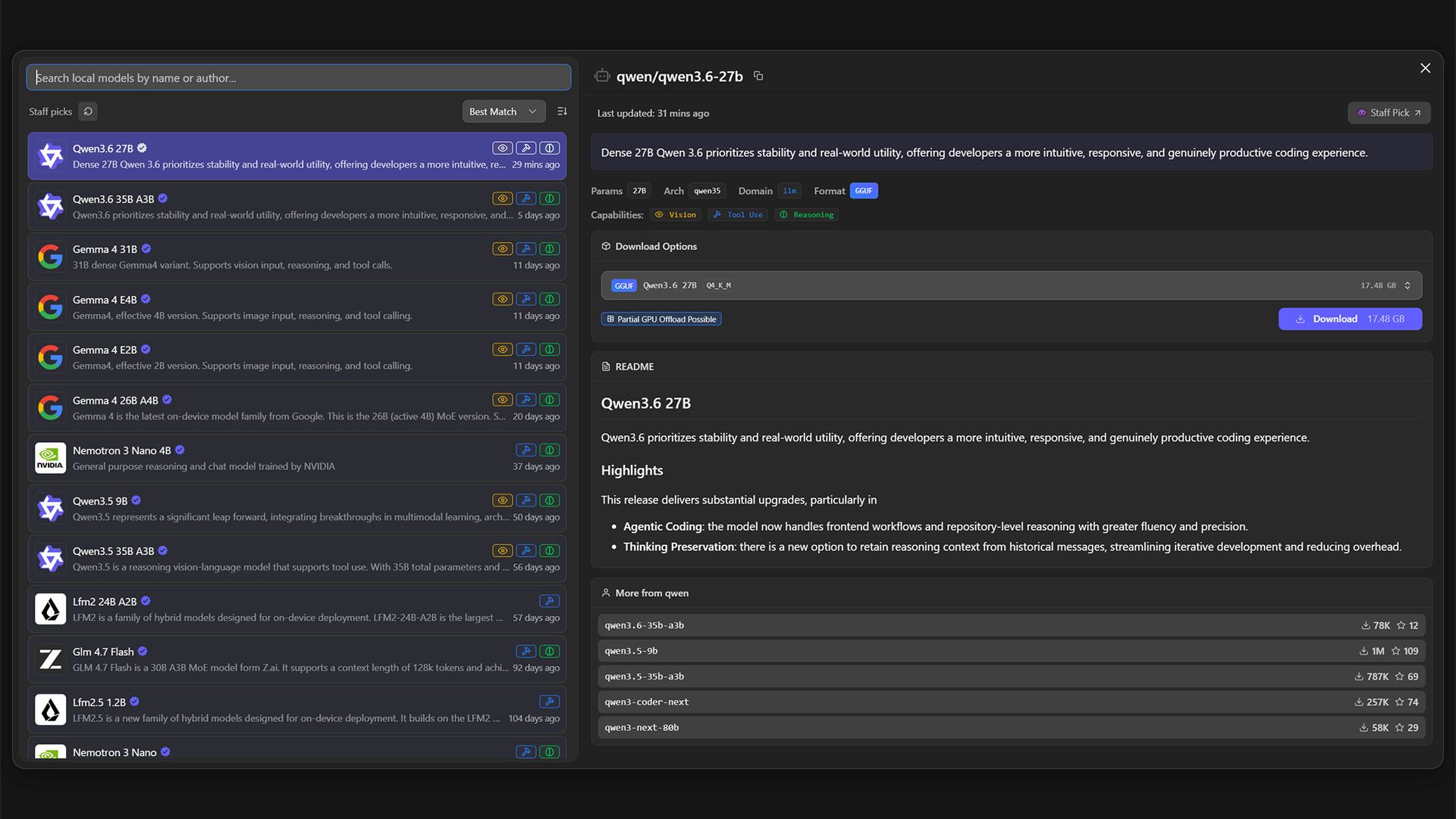

Discovery service для моделей

Встроенный поиск напрямую взаимодействует с платформой Hugging Face. Умная система сама проверяет ваш ПК и показывает цветные подсказки: зелёный цвет означает, что памяти хватит; жёлтый предупреждает о снижении скорости; красный сообщает о нехватке видеопамяти.

Настройка системного промта

Системный промт — базовая команда. Здесь человек задаёт роль (например, «отвечай как программист»), стиль общения и строгие правила поведения.

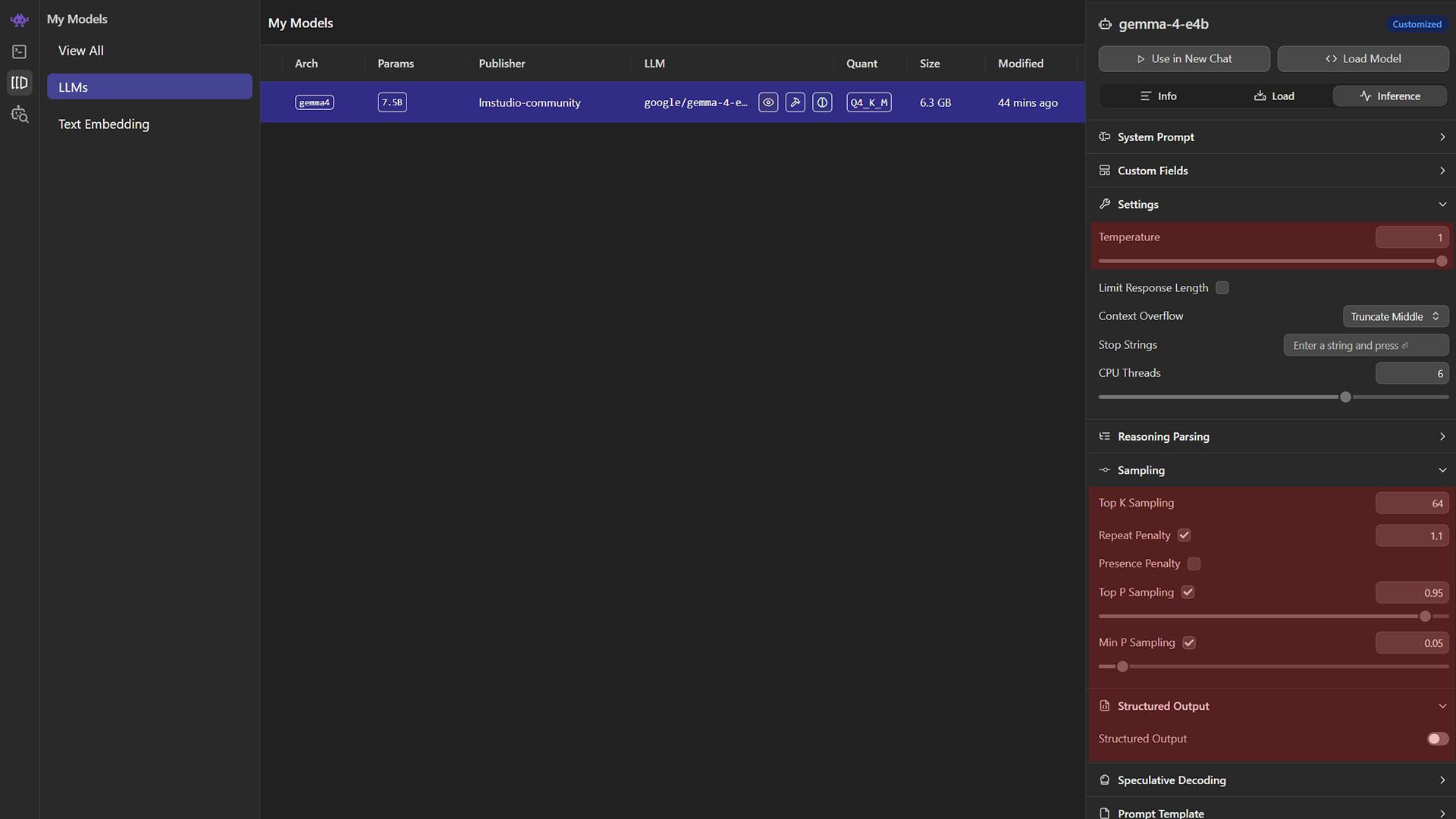

Параметры генерации

Детальные настройки позволяют напрямую управлять процессом:

- Temperature. Делает ответы более точными или более творческими;

- Top-p и Top-k. Инструменты отсекают маловероятные слова;

- Repeat Penalty. Штраф не даёт модели повторять одни и те же фразы;

- Max Tokens. Ограничивает длину текста;

- Structured Output (JSON). Заставляет нейросеть отвечать строго в виде кода, что критически важно для программистов.

Подробнее о каждом из параметров расскажем чуть ниже.

Локальный API-сервер

Разработчики встроили в программу веб-сервер, команды которого полностью совпадают со стандартом OpenAI, обеспечивая полную совместимость c API OpenAI. Любые сторонние приложения могут общаться с локальной нейросетью так же легко, как с платной версией от OpenAI.

MCP-сервер

Протокол Model Context Protocol позволяет нейросети безопасно выходить за пределы окна чата. Через специальные плагины модель читает файлы на диске, ищет информацию в базах данных или находит новости в Сети.

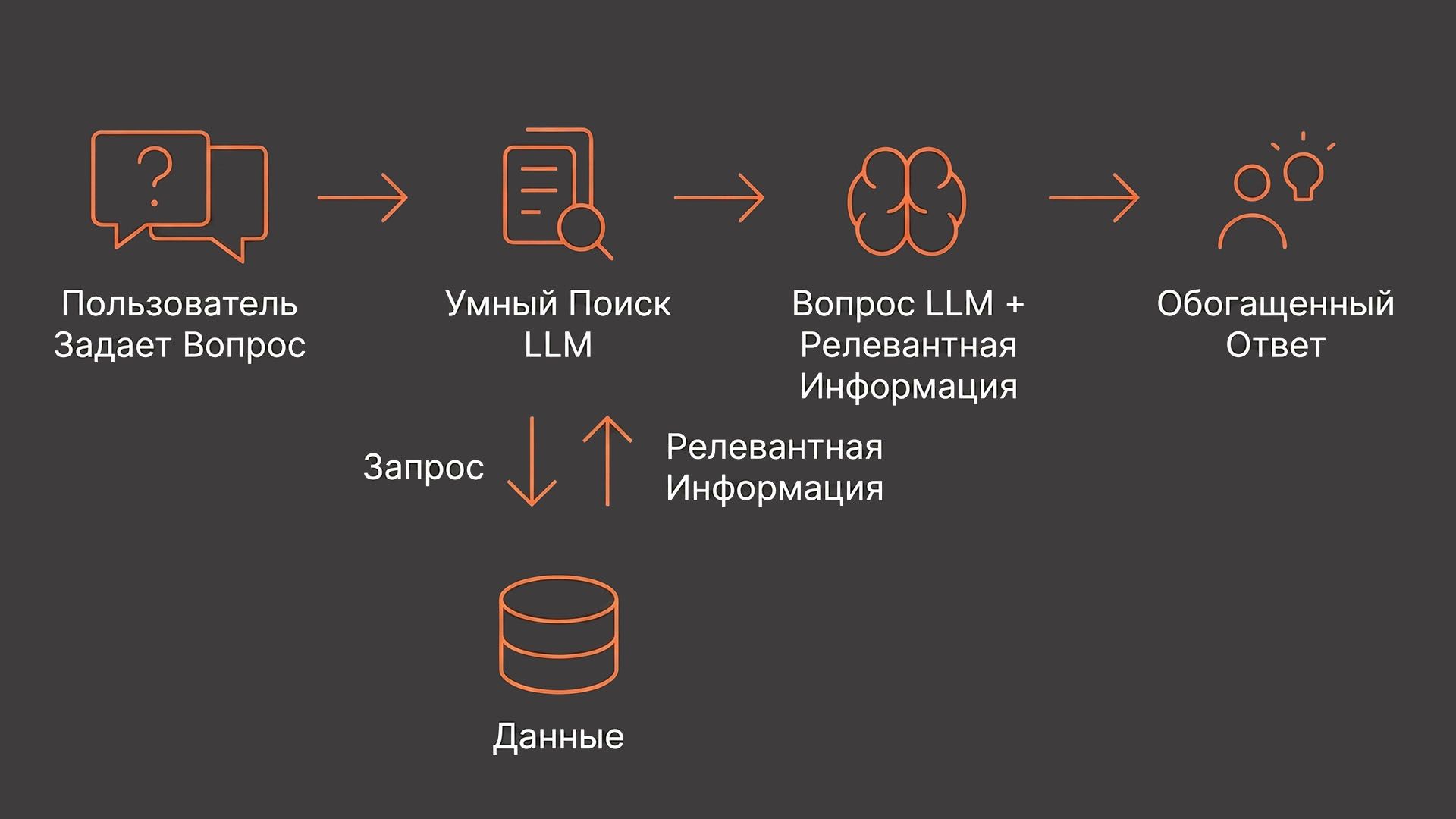

RAG (Retrieval Augmented Generation) «из коробки»

Базовые нейросети обладают огромной эрудицией, но они ничего не знают о вас, ваших личных файлах или внутренних документах вашей компании. Технология RAG (поиск, дополняющий генерацию) элегантно решает эту проблему.

Как это работает простыми словами

Представь, что нейросеть — это студент на экзамене, которому задали очень специфический вопрос. Вместо того чтобы заставлять его угадывать или формулировать ответ по памяти, технология RAG даёт ему в руки нужный учебник (твои документы), позволяет быстро найти правильный абзац и только потом сформулировать точный и обоснованный ответ.

Возможности RAG в LM Studio

Разработчики встроили эту сложную технологию прямо в интерфейс через функцию «Чат с документами». От пользователя не требуется никаких дополнительных настроек:

- Простота загрузки. Просто перетаскиваешь файлы форматов PDF, TXT или DOCX прямо в окно чата;

- Умная обработка. Короткие документы модель «проглатывает» целиком. Если текст длинный, программа автоматически дробит его на небольшие смысловые фрагменты (чанки) и создаёт внутренний поисковик. Так ИИ не перегружает свою память и ищет нужную информацию мгновенно;

- Безопасность и лимиты. Ограничение на один загружаемый файл составляет 30 МБ. Самое главное — весь процесс разбивки текста, поиска фактов и генерации ответа происходит строго локально, без какого-либо доступа к интернету.

Практическое применение в реальной жизни

- Финансы. Бухгалтеры загружают годовые отчёты и просят ИИ: «Сведи расходы за третий квартал в таблицу»;

- IT и разработка. Программисты «скармливают» нейросети огромные журналы системных ошибок (логи), чтобы быстро найти причину сбоя на сервере;

- Наука. Исследователи загружают десятки статей, поручая ИИ сделать из них короткие выжимки главных гипотез;

- Юриспруденция. Юристы направляют ИИ на многостраничные договоры с задачей найти скрытые риски или невыгодные условия.

Найдите станцию под вашу профессию

Укажите вашу сферу (3D, видео, код), чтобы получить варианты

Обзор популярных LLM для LM Studio

В 2026 году открытые бесплатные алгоритмы догнали платные облачные аналоги.

| Название | Главные особенности | Бенчмарки (2026) | Для чего подходит |

|---|---|---|---|

| LLaMA 4 | Рекордная память, понимает очень длинные тексты | Точность 88,2% | Чтение огромных архивов и книг |

| Qwen 3.6 | Знает много языков, версия Coder отлично пишет код | Точность кода 92% | Помощь в программировании |

| DeepSeek | Сначала рассуждает вслух, а потом отвечает (версия R1) | Математика 79,8% | Решение сложных задач и аналитика |

| Gemma 4 | Быстрая и экономичная модель от компании Google | Отличная скорость | Запуск на слабых домашних ПК |

Выбор зависит от объёма видеопамяти. Нейросеть DeepSeek идеально подходит для математики, а Qwen — для написания кода.

Квантизация моделей: форматы и компромиссы

Квантизация моделей выступает главным секретом локального запуска нейросетей.

Обычные модели весят сотни гигабайт. Сжатие немного упрощает внутреннюю математику сети, уменьшая размер файла в несколько раз. Это всегда компромисс: модель становится менее эрудированной, зато начинает работать на домашнем ПК.

| Название формата | Степень сжатия | Качество генерации текста |

|---|---|---|

| Q2/Q3 | Максимальное сжатие | Очень плохое (алгоритм часто ошибается) |

| Q4_K_M | Оптимальное (меньше на 70%) | Хорошее (индустриальный золотой стандарт) |

| Q5_K_M | Лёгкое сжатие | Отличное (пользователь почти не видит ошибок) |

| Q8 | Почти без сжатия | Идеальное (подходит для точных задач) |

Формат GGUF стал стандартом индустрии. Он содержит внутри всё необходимое и позволяет сразу запускать ИИ без сложных настроек. Мощные видеокарты при такой работе выделяют много тепла.

Настройка параметров модели в LM Studio

Тонкая настройка меняет ответы алгоритма.

- System Context. Главная команда. Если написать «возвращай только код без пояснений», ИИ перестанет писать лишний текст.

- Temperature. Настройка случайности в диапазоне от 0,2 до 1,2. Низкое значение выдаёт точные сухие ответы, высокое делает текст творческим;

- Допустимый диапазон: от 0 до 2 (иногда выше)

- Оптимальное значение: 0.1 (для кода/фактов) | 0.8 (для общения)

- Как работает механика: чем ближе к 2.0, тем чаще алгоритм выбирает неожиданные токены, повышая креативность (или шанс бреда)

- Top-p. Инструмент отсекает неподходящие слова;

- Допустимый диапазон: от 0 до 1

- Оптимальное значение: 0.9 или 0.95

- Как работает механика: алгоритм отсекает слова с самой низкой вероятностью. При 0.9 в пуле выбора остаются только те токены, сумма вероятностей которых даёт 90%

- Top-k. Инструмент отсекает неподходящие слова;

- Допустимый диапазон: от 0 до ∞ (размер словаря)

- Оптимальное значение: 40 или 50

- Как работает механика: жёсткий лимит количества вариантов. При значении 40 нейросеть будет выбирать следующее слово строго из топ-40 самых вероятных продолжений

- Repeat Penalty. Настройка не даёт ИИ зацикливаться на одной фразе (рекомендуем ставить 1,1–1,2);

- Допустимый диапазон: от 1.0 до 2.0+

- Оптимальное значение: от 1.1 до 1.2

- Как работает механика: математический штраф за повторение. 1.0 отключает штраф. При значениях выше 1.2 ИИ будет бояться повторить уже сказанное слово и начнёт ломать структуру предложений

- Max Tokens. Лимит длины текста;

- Допустимый диапазон: от 1 до лимита контекста модели+

- Оптимальное значение: -1 (бесконечно) или 2048

- Как работает механика: физическое ограничение объёма ответа. Полезно, если нужно запретить ИИ писать длинные простыни текста или если видеопамяти впритык.

- Structured Output. Удобная функция заставляет отвечать строго в определённом формате (JSON, Markdown).

- Допустимый диапазон: включено / выключено

- Оптимальное значение: выключено (для чата) / включено (для API)

- Как работает механика: не имеет числового диапазона. На вход подаётся строгая схема форматов (JSON). Механика блокирует генерацию любых токенов (букв и символов), которые нарушают заданную структуру кода.

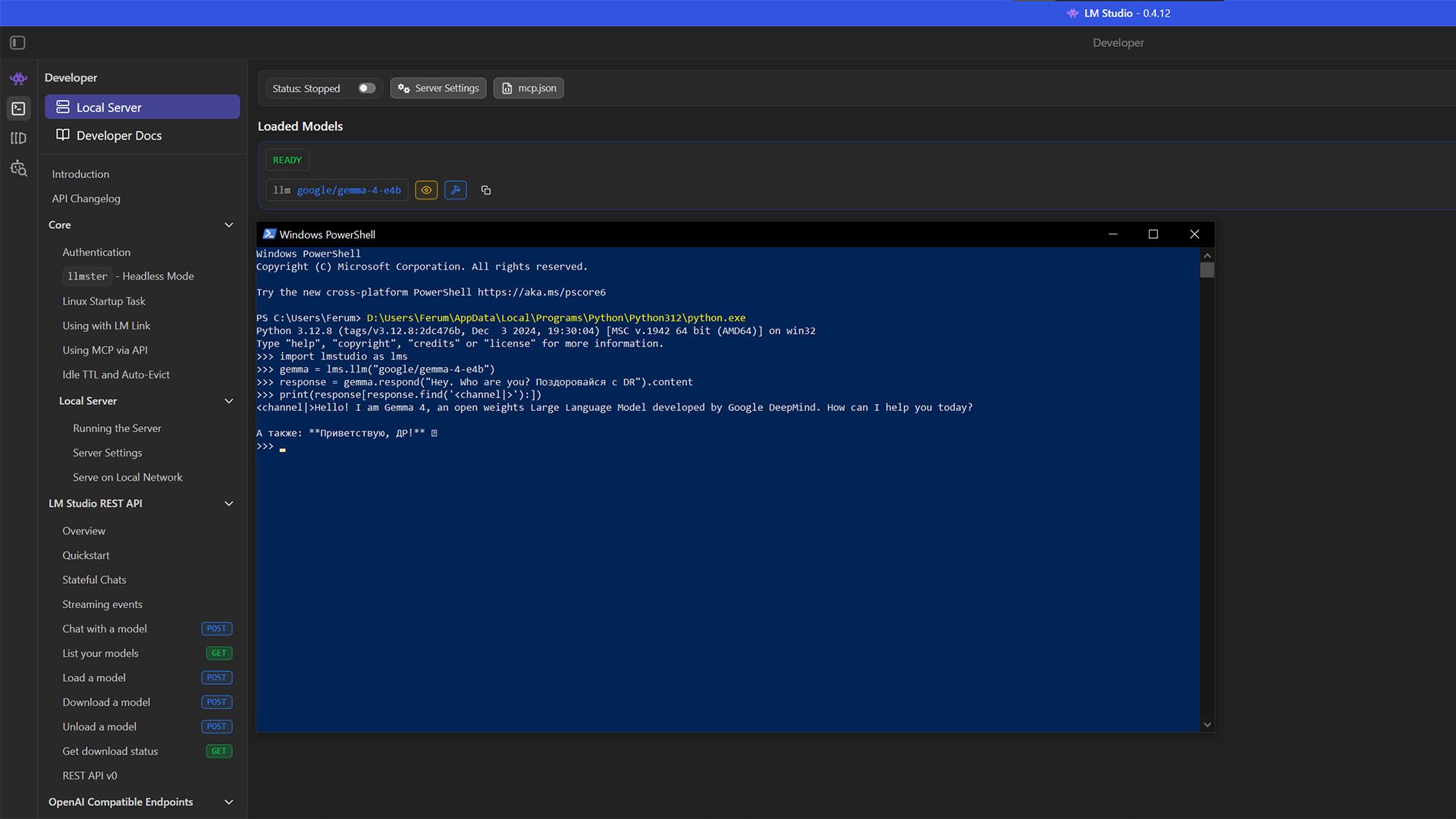

API-сервер в LM Studio: подключение к приложениям

Запуск нейросетей в окне программы — это только начало. Встроенный сервер позволяет писать скрипты на языках Python и TypeScript для автоматизации процессов.

Пример простого кода на Python:

import lmstudio as lms

model = lms.llm("qwen/qwen3-4b-2507") # Подключаемся к модели

result = model.respond("What is the meaning of life?") # Отправляем запрос

print(result) # Выводим ответ

Подобный код позволяет подключить ИИ к боту в Telegram или к редактору кода (IDE).

Альтернативы LM Studio

Выбор конкретного инструмента зависит от технической подготовки и целей. Если для одних важна красивая оболочка, то другим нужна гибкость командной строки для встраивания ИИ в рабочие процессы. А корпоративному сегменту зачастую требуются решения, готовые к работе прямо «из коробки».

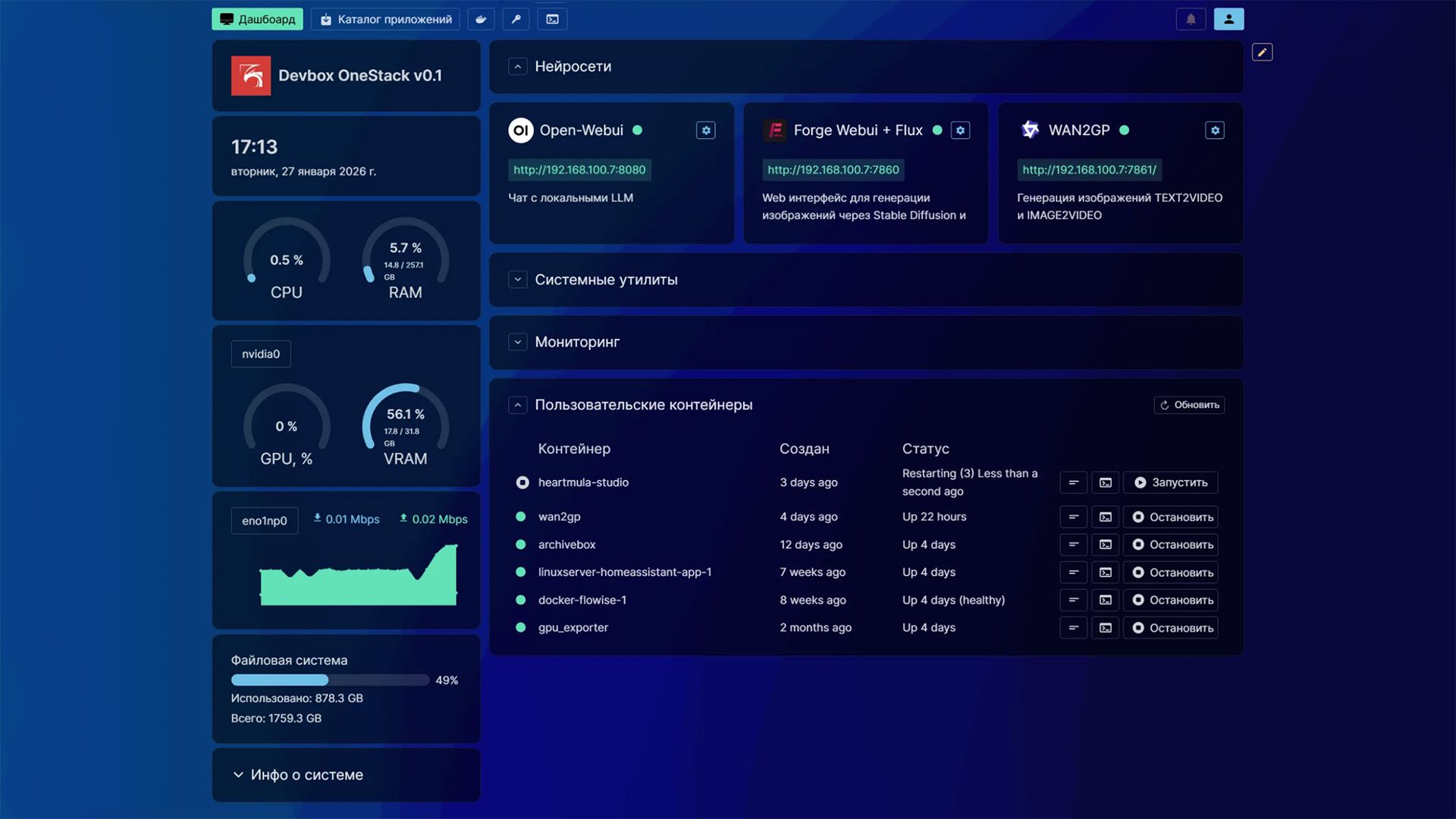

DigitalRazor OneStack: корпоративный ИИ под ключ

Если в команде нет выделенных DevOps-инженеров, а тратить недели на настройку Linux, драйверов и контейнеров не хочется, оптимальным выбором станет программно-аппаратный комплекс DigitalRazor OneStack. Это готовое решение поставляется полностью предустановленным и настроенным на серверах и рабочих станциях компании.

Платформа позволяет быстро развернуть и настроить безопасный корпоративный ИИ-чат (аналог ChatGPT с привычным интерфейсом OpenWebUI), умный поиск по внутренней документации (RAG) и полноценное рабочее место ML-разработчика. Главное преимущество — система поддерживает режим «воздушного зазора» (Air-gapped) и работает в полностью закрытом контуре без доступа к интернету. Это гарантирует абсолютную безопасность чувствительных данных, при этом комплекс инструментов не требует ежемесячных лицензионных платежей за программное обеспечение.

Ollama: выбор разработчиков и DevOps

Этот инструмент выбирают те, кто предпочитает работать через терминал. У программы нет графического интерфейса в привычном понимании, зато она предлагает гибкость.

Разработчики используют Ollama для автоматизации задач и развёртывания нейросетей в изолированных контейнерах. Благодаря функции Modelfile пользователи могут создавать собственные модификации моделей, задавая им уникальные параметры и системные промпты.

GPT4All: ИИ в один клик

Проект от Nomic AI ориентирован на максимально быстрый старт. Программа предлагает пользователю ограниченный, но тщательно отобранный список моделей, которые гарантированно запустятся на большинстве современных домашних систем.

Здесь также есть встроенный механизм работы с документами (LocalDocs), однако он даёт меньше контроля над параметрами генерации текста по сравнению с LM Studio. Это отличный вариант для первого знакомства с локальным ИИ, когда не хочется тратить время на технические детали.

Jan: прозрачность и открытость

Для тех, кто ценит полную открытость исходного кода, существует Jan. Приложение обладает лаконичным интерфейсом и позволяет подключать модели через интеграцию с различными хабами.

Хотя инженерия промптов здесь развита чуть слабее, чем в LM Studio, программа привлекает своей философией и кроссплатформенностью.

| Программа / Решение | Основной подход | Управление моделями | Особенности |

|---|---|---|---|

| LM Studio | Мощный GUI + API | Встроенный маркетплейс | Золотая середина. Есть RAG и MCP из коробки |

| OneStack | Готовое ПО + Железо | Готовый веб-интерфейс | Идеально для бизнеса. Настроено из коробки, без подписок |

| Ollama | Командная строка (CLI) | Загрузка через терминал | Идеально для Docker, серверов и автоматизации |

| GPT4All | Простота для новичка | Кураторский список | Встроенный RAG (LocalDocs), но мало настроек |

| Jan | Чистый визуальный ИИ | Интеграция с хабами | Полностью открытый код (100% Open Source) |

Сравнение актуальных аналогов LM Studio

Практические примеры использования LM Studio

В реальных рабочих сценариях платформа превращается в универсального цифрового помощника. Инструмент решает множество рутинных и творческих задач, гарантируя полную конфиденциальность данных. Вот пять главных направлений, где программа показывает максимальную эффективность.

Аудит и оптимизация программного кода

Нейросеть Qwen 3 Coder подключается напрямую к среде разработки. Алгоритм на лету проверяет свежие изменения в программном коде, находит скрытые уязвимости и самостоятельно предлагает элегантные исправления. Весь коммерческий исходный код стартапа остаётся в полной безопасности на жёстком диске компьютера. Подобный подход сильно ускоряет создание сложных проектов, например, при разработке визуальных эффектов (подробнее об их устройстве читайте в материале «Что такое шейдеры в играх»).

Анализ закрытой документации и отчётов

Сотрудник финансового отдела просто перетаскивает 40-страничный документ PDF в окно чата и просит свести расходы за год в единую таблицу. Модель мгновенно сканирует текст, отсеивает фоновый словесный шум и выдаёт точные цифры. Это идеальный сценарий для безопасной работы с юридическими и финансовыми бумагами, которые защищают строгие соглашения о неразглашении (NDA).

Умные агенты (MCP) для работы в Сети

Искусственный интеллект больше не заперт в своей изначальной базе знаний. Через интеграцию плагинов MCP модель сама открывает нужные сайты в браузере, читает объёмные статьи и делает короткий осмысленный пересказ. Например, алгоритм легко соберёт актуальные цены, изучит бенчмарки и поможет быстро сравнить самые мощные видеокарты в мире, избавив человека от долгого ручного поиска цифр и дополнительной информации.

Обработка системных логов и поиск сбоев

Системный администратор загружает в программу огромные текстовые журналы с отчётами об ошибках. Вместо долгого ручного чтения тысяч монотонных строк человек просто спрашивает ИИ о причине падения системы. Нейросеть находит сбойный код и сразу предлагает вариант решения проблемы. Впрочем, чтобы аппаратных сбоев изначально было меньше, стоит регулярно обслуживать оборудование — подробные инструкции есть в нашей статье «Как продлить срок службы сервера».

Помощь сценаристам и разработчикам видеоигр

Игровые студии активно применяют тяжёлые языковые алгоритмы для написания нелинейных диалогов, сложных квестов и внутриигровой литературы (лора). Локальный запуск позволяет бесконечно экспериментировать с развитием сюжета и характером персонажей без оглядки на жёсткую цензуру облачных платформ. Существует высокая вероятность, что сценарии для самых ожидаемых игр 2026 года уже частично редактируют с помощью подобных автономных нейросетей.

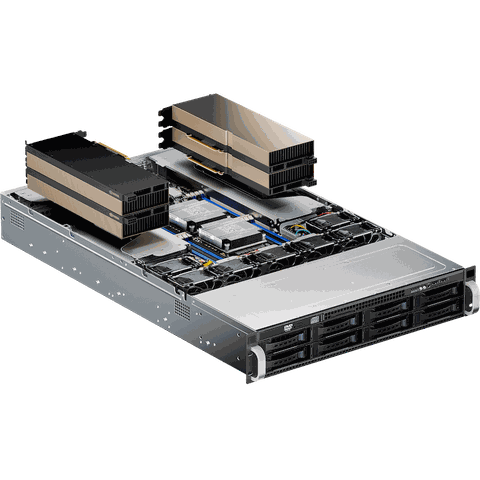

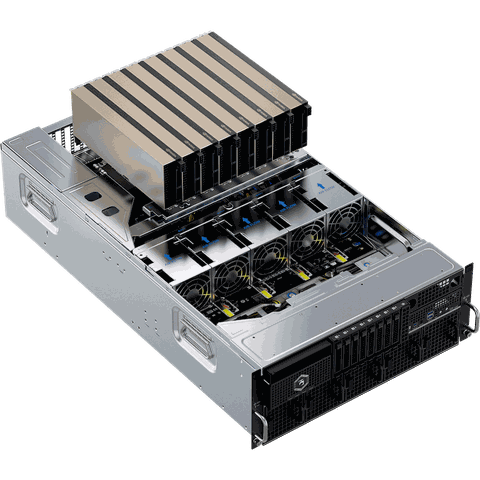

Для того чтобы алгоритмы быстро обрабатывали большие массивы информации и не заставляли ждать ответ по несколько минут, нужна соответствующая аппаратная база. Вот несколько примеров наших систем:

Часто задаваемые вопросы (FAQ)

Итог

Локальные нейросети перестали быть уделом избранных инженеров. LM Studio превратила запуск ИИ в предельно простой процесс. Это идеальное решение для безопасной работы с данными, написания кода и генерации идей без оглядки на цензуру или платные подписки облачных гигантов.

Но скорость работы алгоритмов жёстко упирается в вычислительную мощь. Тяжёлым моделям нужны внушительные объёмы видеопамяти. А чтобы ИИ-помощник отвечал мгновенно, нужна грамотно сбалансированная система.

Избежать ошибок при подборе такого железа очень просто. Напиши нам: поможем тебе собрать мощный компьютер или рабочую станцию для работы с любыми ИИ-задачами. А по промокоду MINUS5 сделаем скидку 5 тысяч рублей на игровые компьютеры.