Сбер выпустил открытые новые MoE-модели GigaChat 3.1

/files/upload/iblock/a55/a555a2fe1beba3c539a33c23853b79fc.png)

Подберём игровой ПК за 2 шага

Ответьте на несколько вопросов — покажем готовые сборки

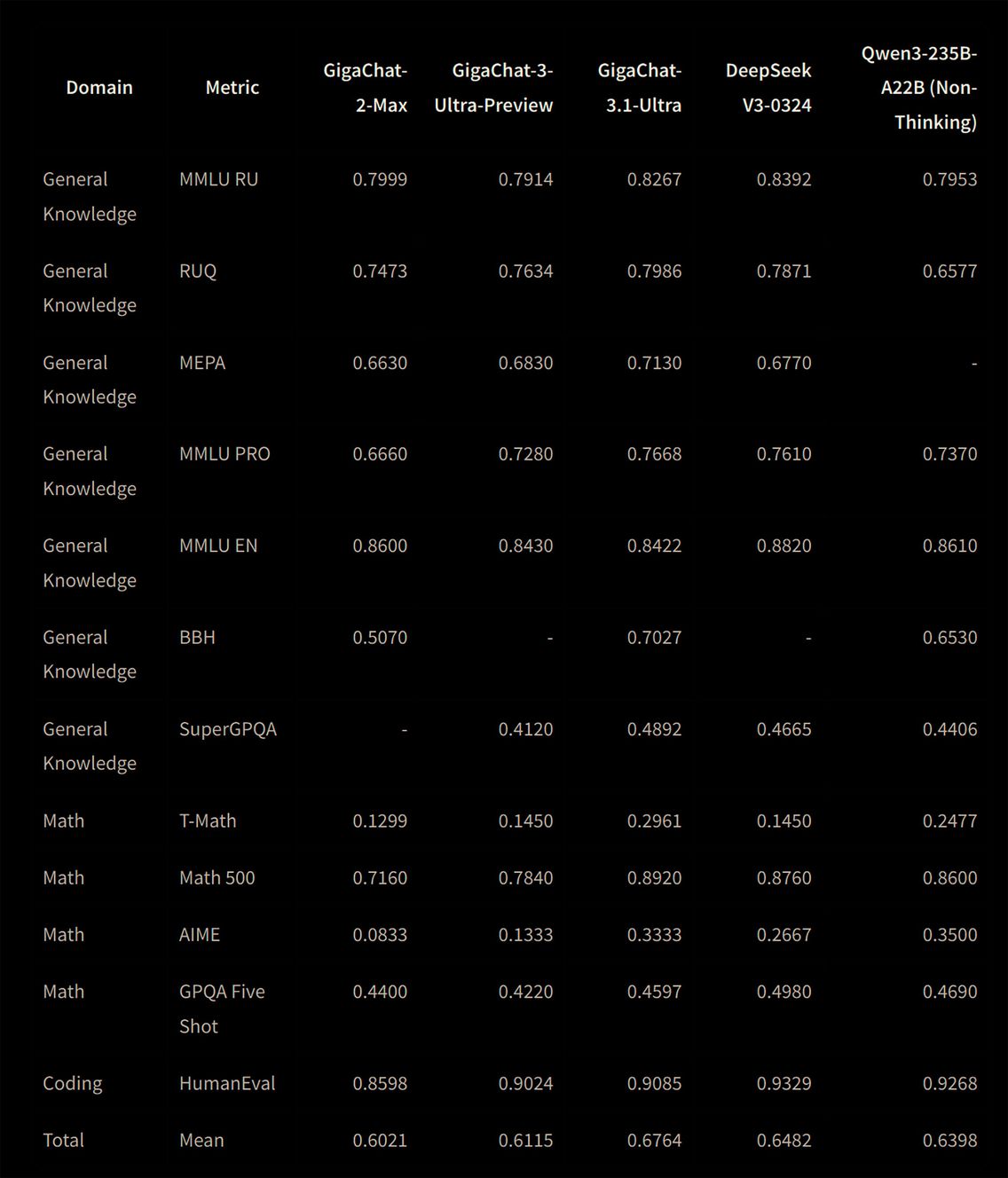

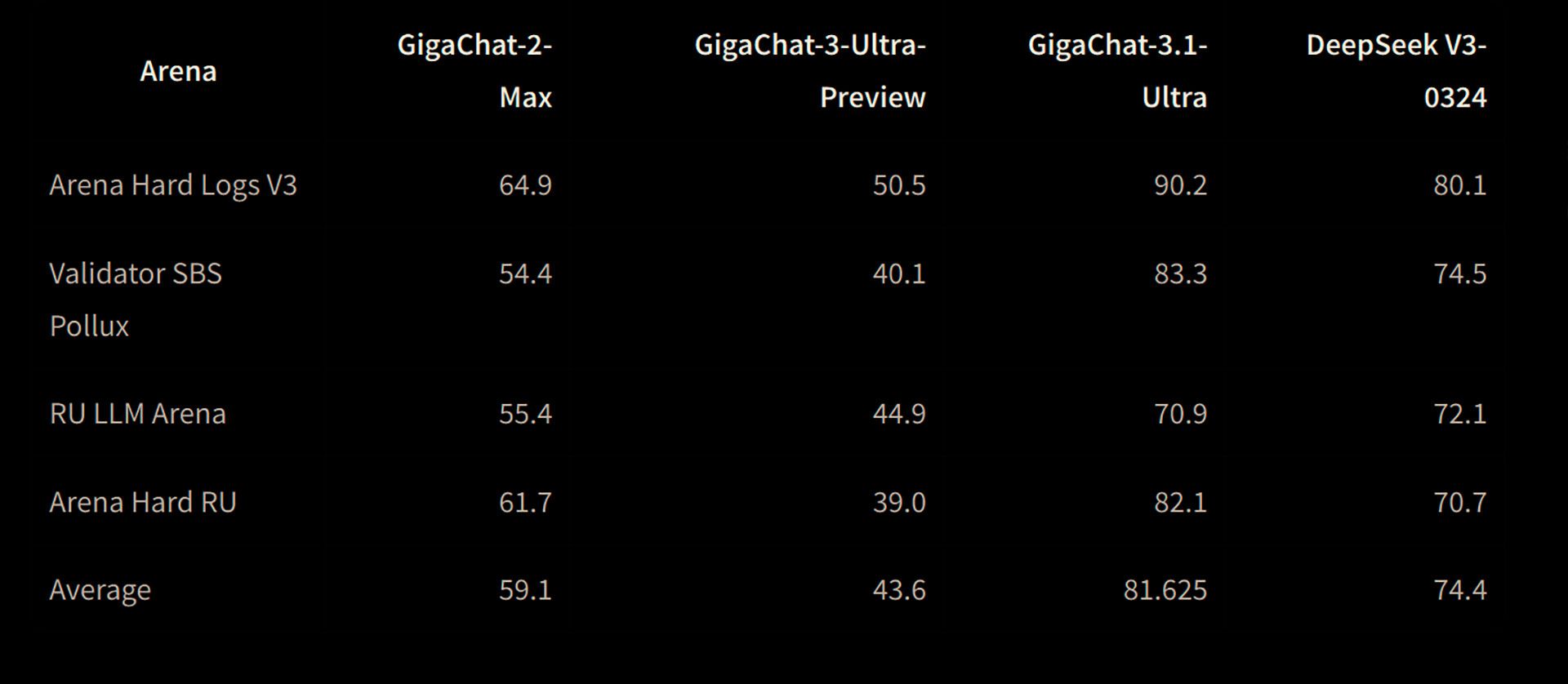

Отечественная корпорация официально выпустила крупное обновление фирменного семейства больших языковых моделей. Компания представила сразу две новые нейросети — GigaChat-3.1-Ultra и GigaChat-3.1-Lightning. Обе новинки получили поддержку функции рассуждения, огромное контекстное окно и стали доступны для использования под полностью открытой лицензией MIT.

Краткое содержание

- Сбер выпустил языковые модели GigaChat-3.1-Ultra и Lightning;

- В основу нейросетей легла эффективная архитектура MoE;

- Старшая модель Ultra получила 702 миллиарда параметров;

- Контекстное окно новинок расширено до 256 тысяч токенов;

- Исходный код доступен бесплатно по открытой лицензии MIT.

Переход на архитектуру MoE

Главным нововведением в релизе стало принципиальное изменение структуры языковых моделей. Создатели отказались от плотной архитектуры в пользу MoE. Такая компоновка предполагает, что при генерации ответов активируется лишь небольшая часть доступных параметров нейросети. Подобный подход позволяет существенно снизить требования к аппаратному обеспечению при локальном развёртывании системы. Младшая модель Lightning располагает 10 миллиардами параметров, в то время как старшая версия Ultra насчитывает 702 миллиарда.

Увеличенное контекстное окно

Вместо стандартного механизма внимания теперь применяется технология MLA. Это решение сжимает данные кэша в латентное представление. В результате нейросеть потребляет гораздо меньше оперативной памяти и работает значительно быстрее при обработке длинных текстов и сложных запросов. Контекстное окно новинок достигает 256 тысяч токенов, что даёт возможность загружать в модель целые книги или огромные массивы технической документации.

Снижение потребления памяти и рост скорости

В процессе создания GigaChat 3.1 команда провела масштабную работу над ошибками прошлых версий. Новые модели стали гораздо реже галлюцинировать и практически перестали уходить в бесконечные циклы генерации текста. Особое внимание специалисты уделили оптимизации процесса инференса.

В новых релизах больше не используется посттренировочная квантизация. Этот метод хорошо показывал себя в синтетических тестах, но негативно влиял на качество работы нейросети в реальных задачах. Вместо этого этап оптимизации полностью перевели в режим вычислений FP8. Такое решение увеличило общую эффективность алгоритмов и сократило потребление видеопамяти ровно в два раза. Дополнительное применение технологии MTP обеспечило моделям прирост скорости инференса до 38% по сравнению с предыдущими базовыми версиями.

Новые нейросети отлично подходят для создания умных корпоративных ассистентов, продвинутых чат-ботов и различных приложений на базе ИИ. Для стабильной работы и обучения подобных моделей отлично подходят современные серверы для искусственного интеллекта, оснащённые мощными графическими ускорителями. Младшую версию можно локально развернуть и на рабочих станциях.

Не пропусти главное в мире ПК

Мы публикуем последние новости из компьютерного мира. Подписывайся, чтобы быть в курсе и ничего не пропустить.