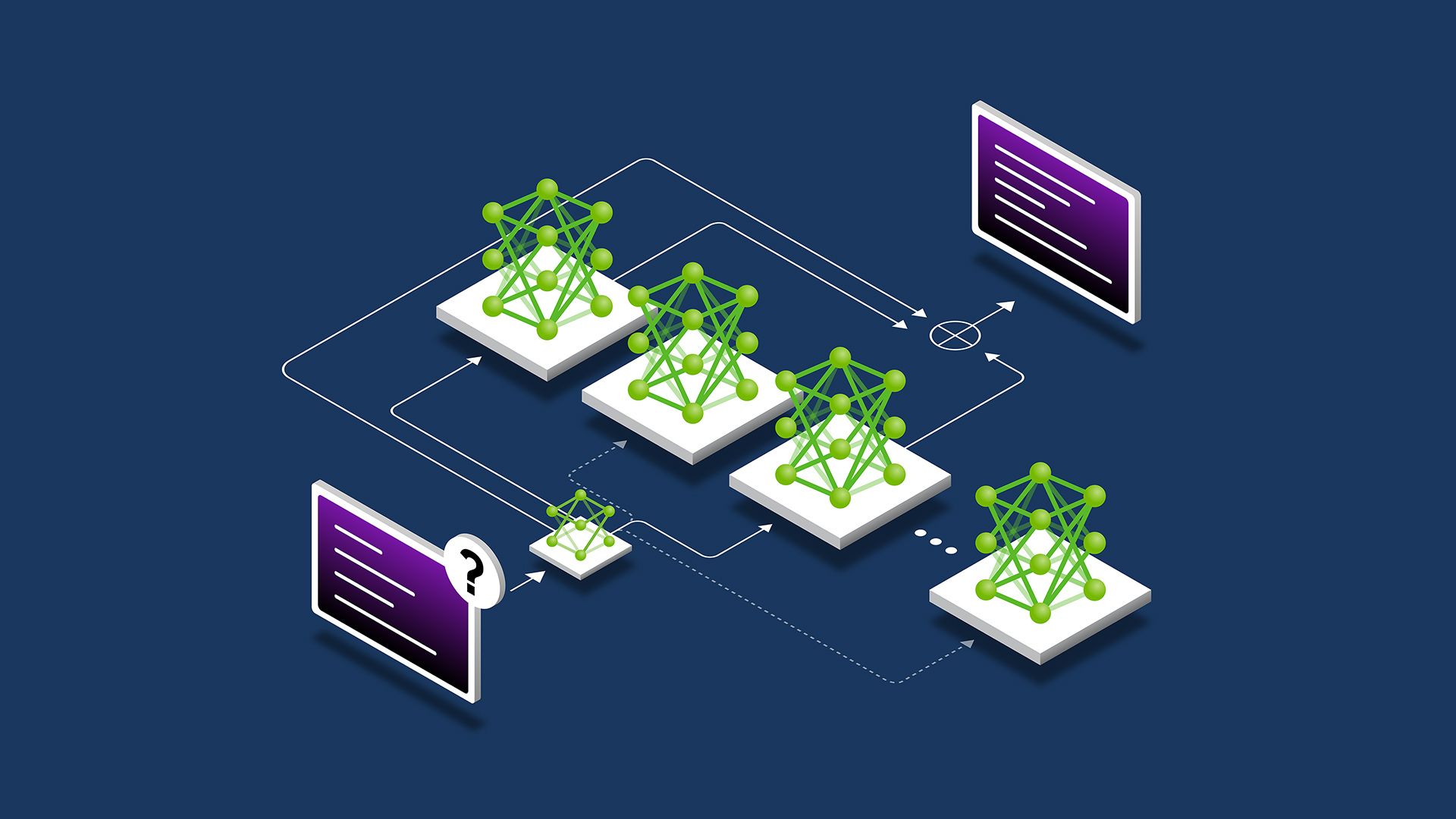

Что такое Meta LLaMA

LLaMA — это открытая языковая модель нового поколения. Её можно запускать локально, без облака и сторонних сервисов, сохраняя безопасность и контроль над данными. LLaMA помогает генерировать тексты, анализировать информацию, автоматизировать процессы и дообучаться на ваших данных.

Мощные рабочие станции

Производительные системы с одной или двумя GPU для локального запуска нейросетей. Подходят разработчикам, исследователям и стартапам, которым важны мощность и автономность.

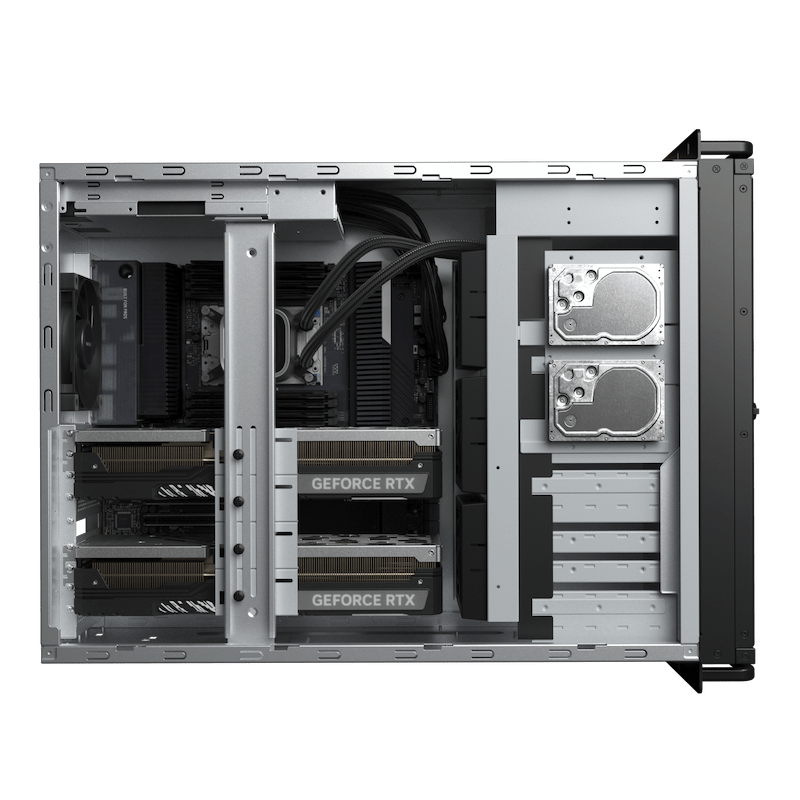

Рабочие станции для дообучения LLM

Персональные вычислительные кластеры на базе 4-х видеокарт с единым контуром жидкостного охлаждения. Обеспечивают суммарный объем VRAM для локального запуска (Inference) и дообучения (Fine-Tuning) топовых LLM, включая DeepSeek и Llama 3. Кастомная СЖО гарантирует полную тишину и отсутствие троттлинга даже при круглосуточных нагрузках в офисных условиях.

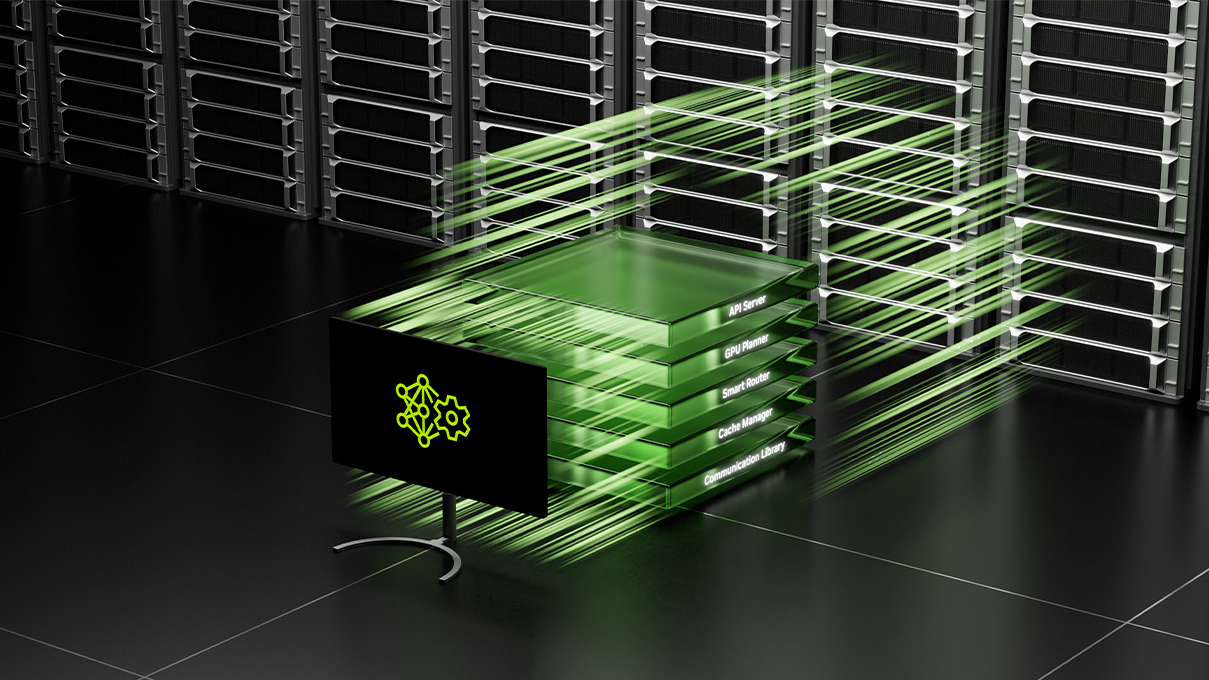

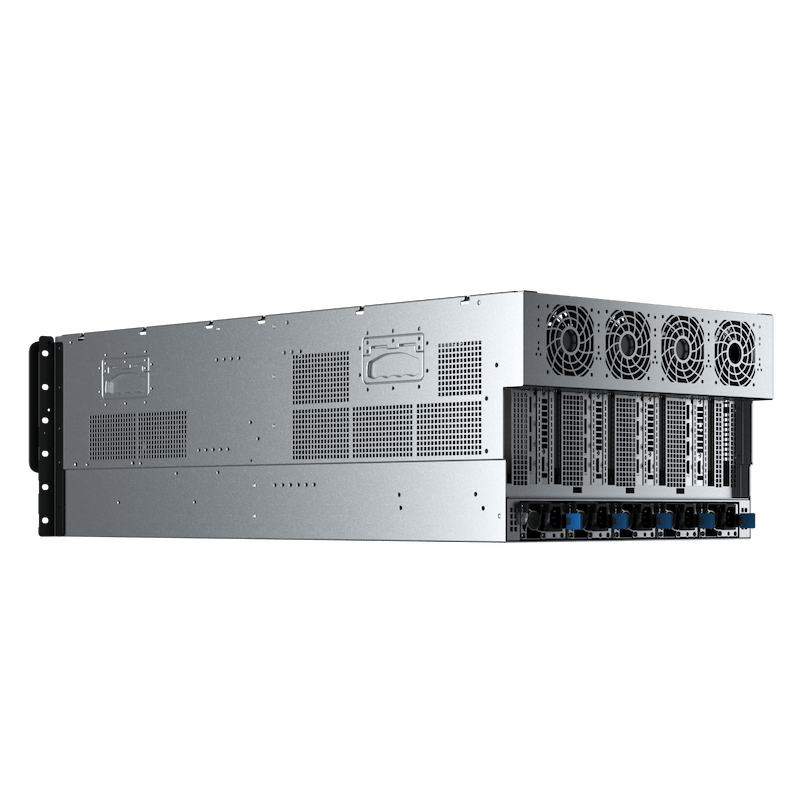

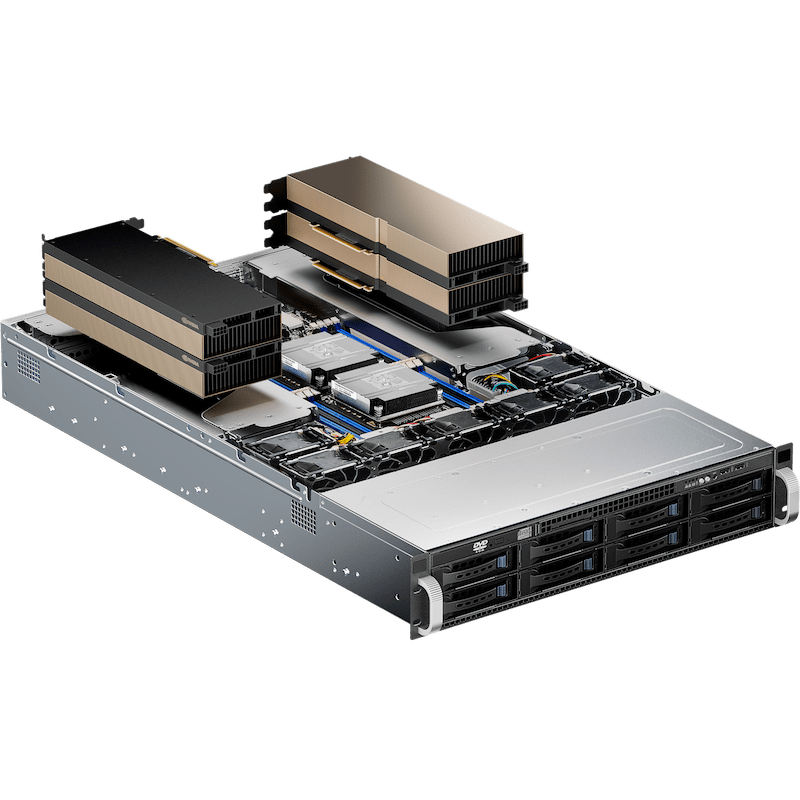

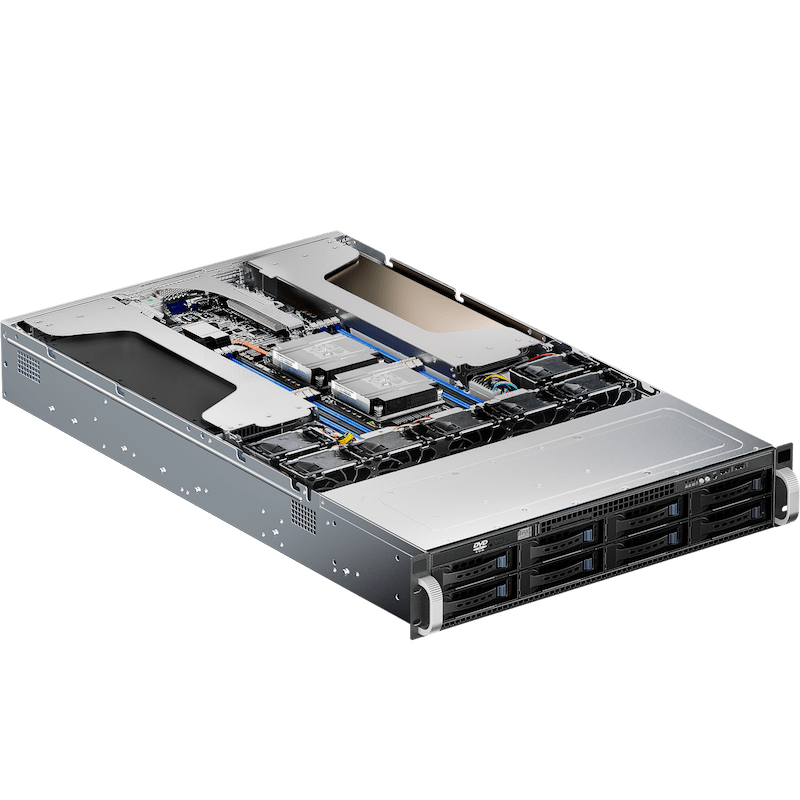

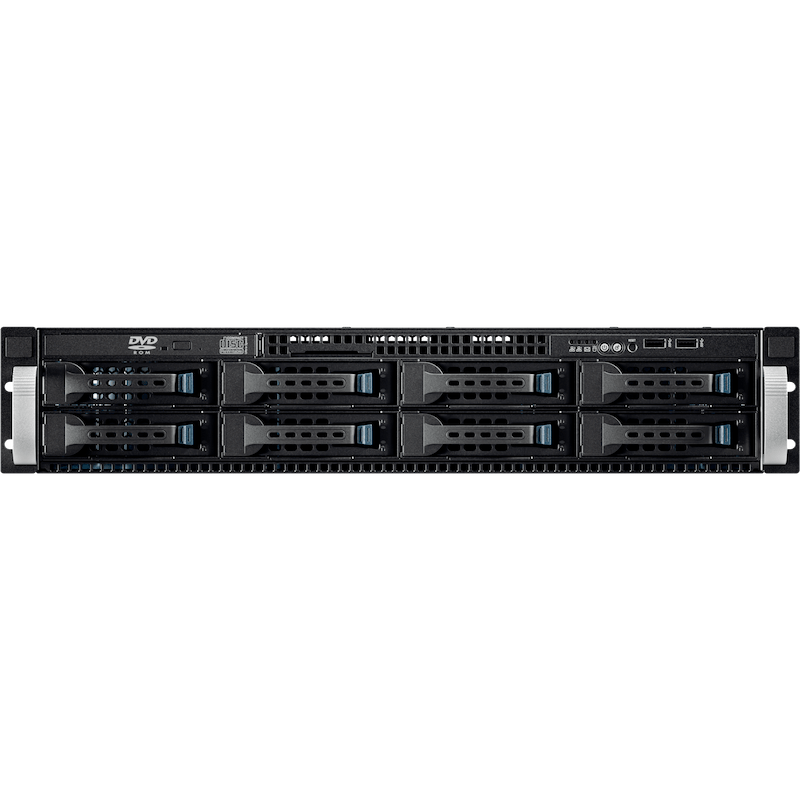

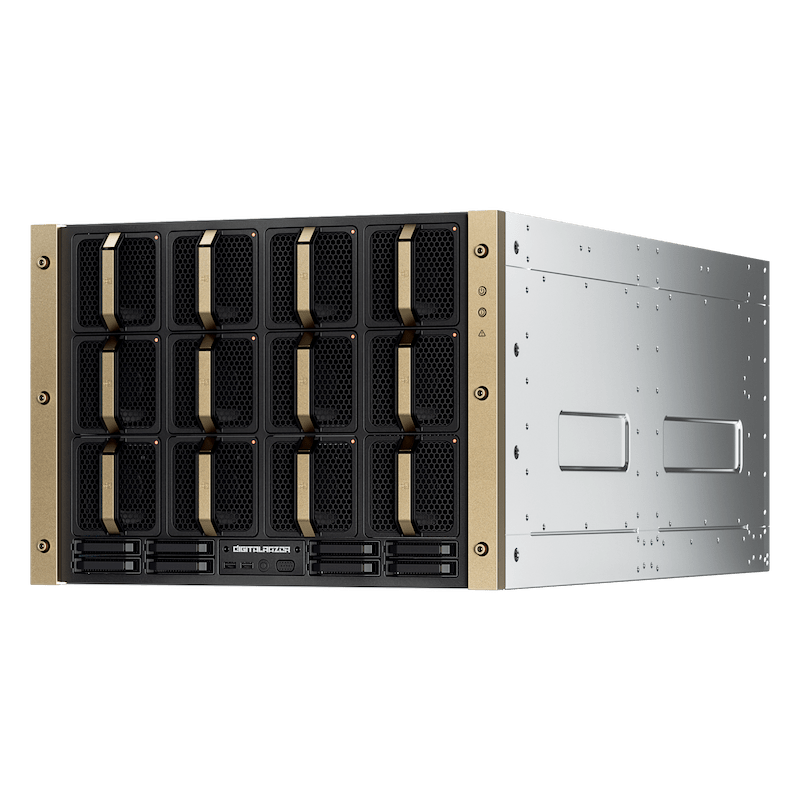

Серверы для AI и нейросетей

Мощные вычислительные узлы с усиленным охлаждением для установки в серверные комнаты. Предназначены для масштабного обучения языковых моделей (LLM), построения вычислительных кластеров и задач, где требуется максимальная производительность на единицу стоечного пространства.

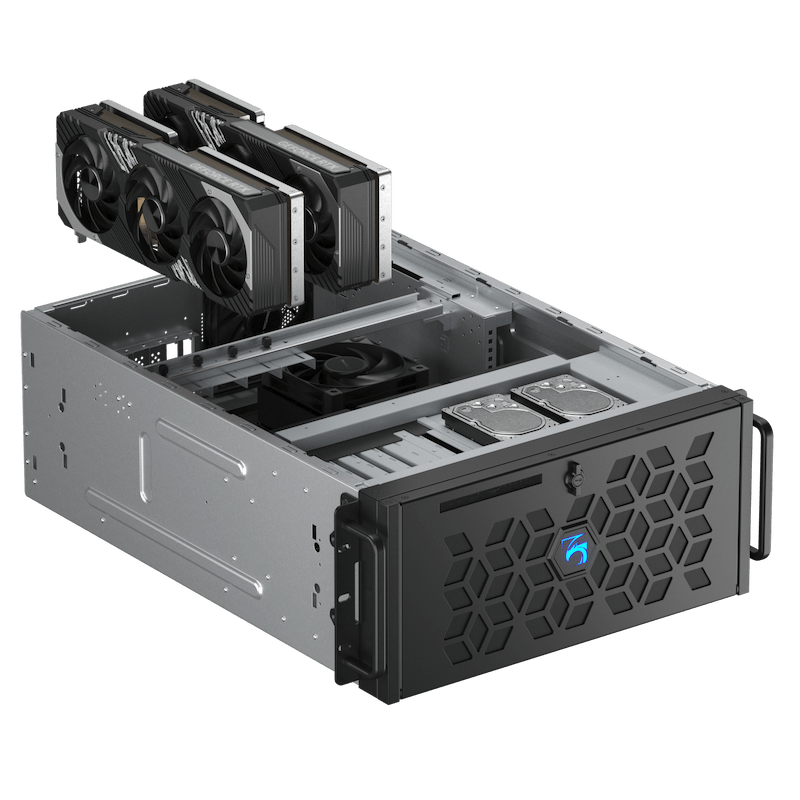

Узнать большеRackstation AI

Компактный GPU-сервер до 2 видеокарт для начальных задач в AI и графике. Оптимален для инференса, визуализации, VFX и рендеринга в студиях и лабораториях, где важна гибкость.

Процессоры

Количество ядер CPU

Видеокарты

Количество видеокарт

Оперативная память

Размеры

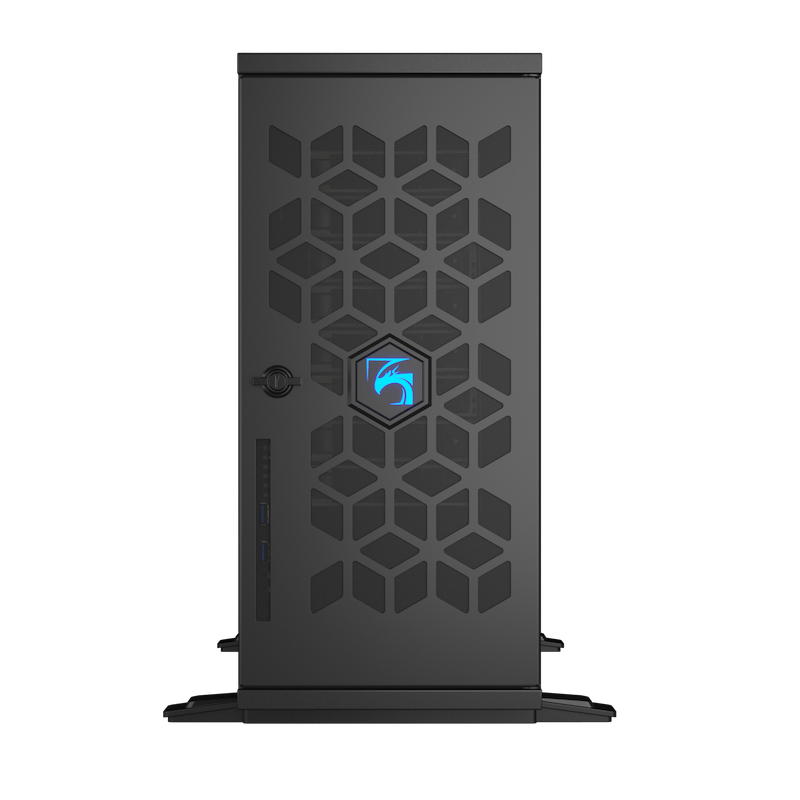

Devbox AI

Универсальная платформа на 4–6 GPU для локального обучения моделей и генеративных задач. Подходит для команд, которым важна надёжность сервера и свобода выбора графики — от RTX 5090 до PRO RTX 6000.

Процессоры

Количество ядер

Видеокарты

Количество видеокарт

Оперативная память

Размеры

Scale

Сервер промышленного уровня на 8 GPU с кластерной архитектурой. Предназначен для дата-центров и AI-ферм, где требуется масштабируемость и полная загрузка ресурсов под обучение LLM и R&D.

Процессоры

Количество ядер

Видеокарты

Количество видеокарт

Оперативная память

Размеры

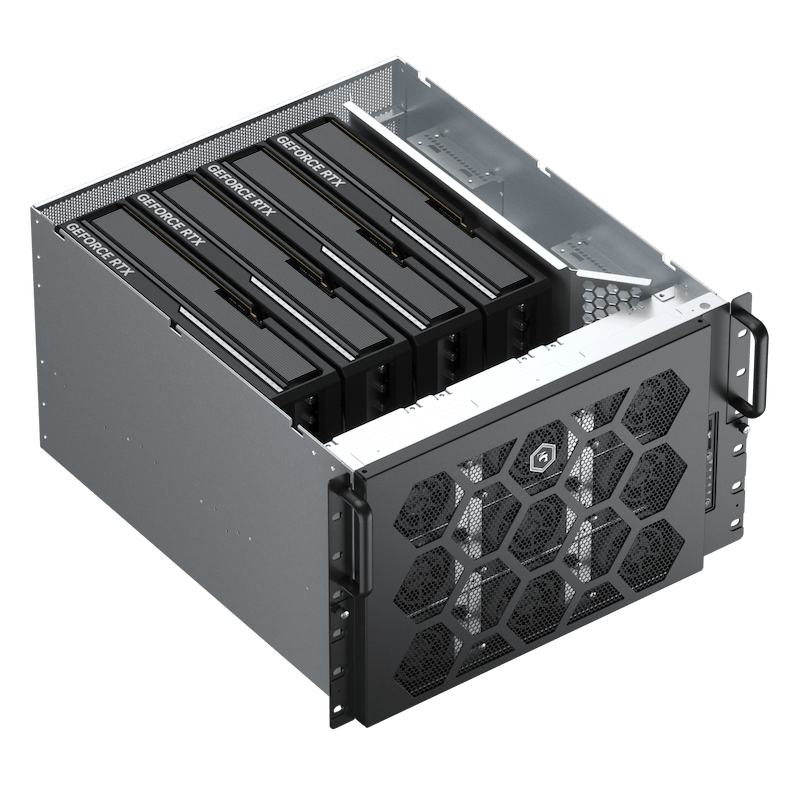

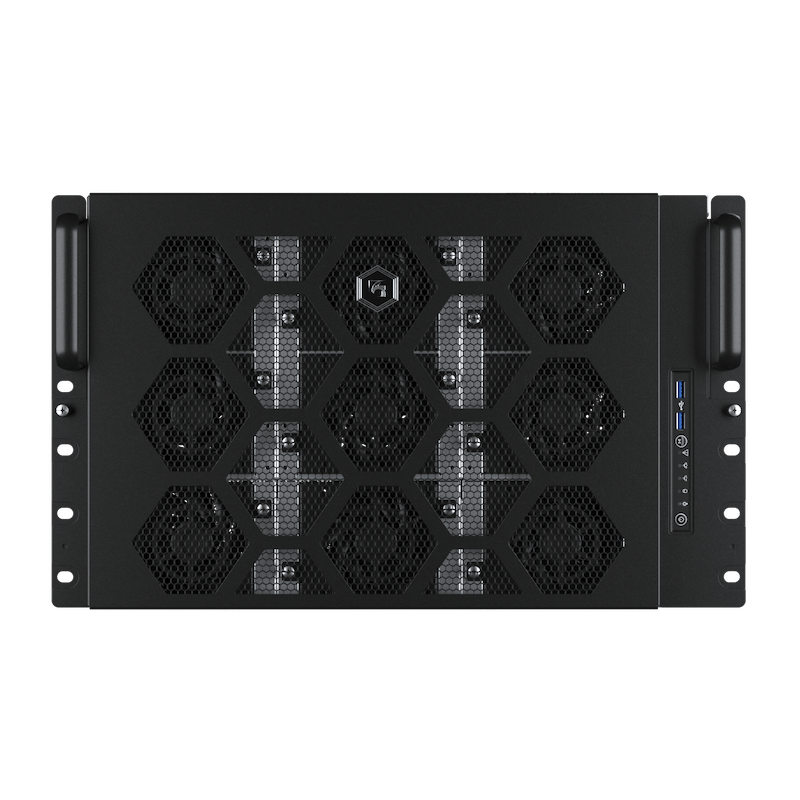

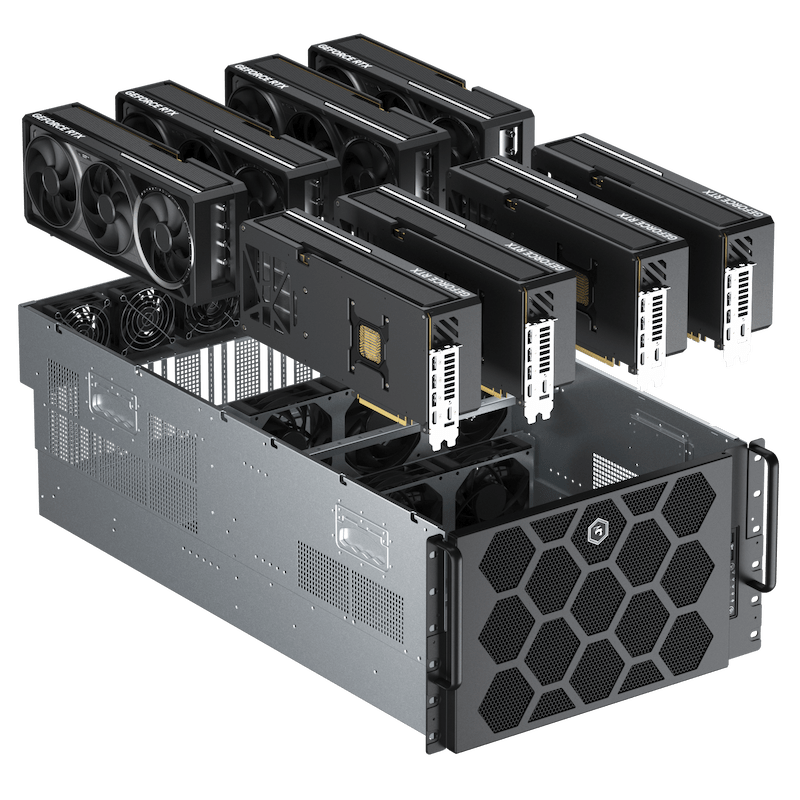

HPC 4000

Серия серверов для кластеризации на 4 GPU. Предназначены для дата-центров и AI-ферм, где требуется повышенная плотность для обучение LLM и R&D.

Процессоры

Количество ядер

Видеокарты

Количество видеокарт

Оперативная память

Размеры

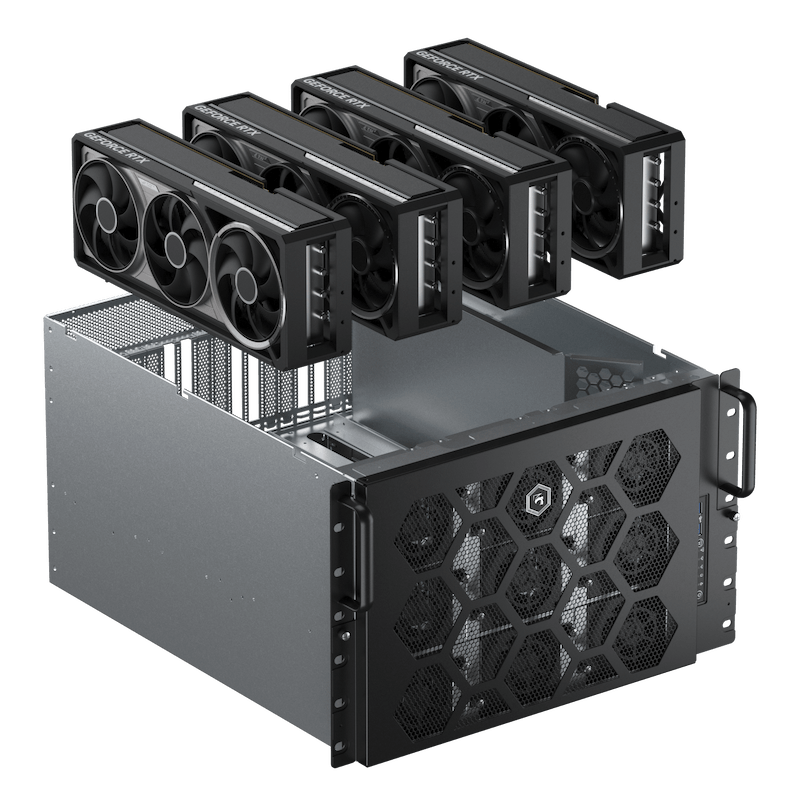

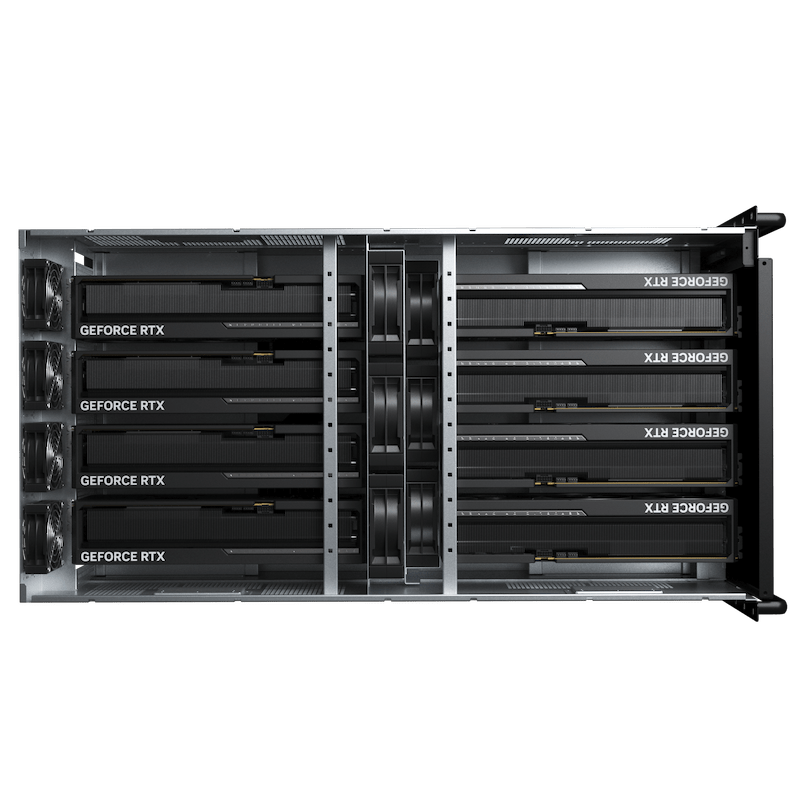

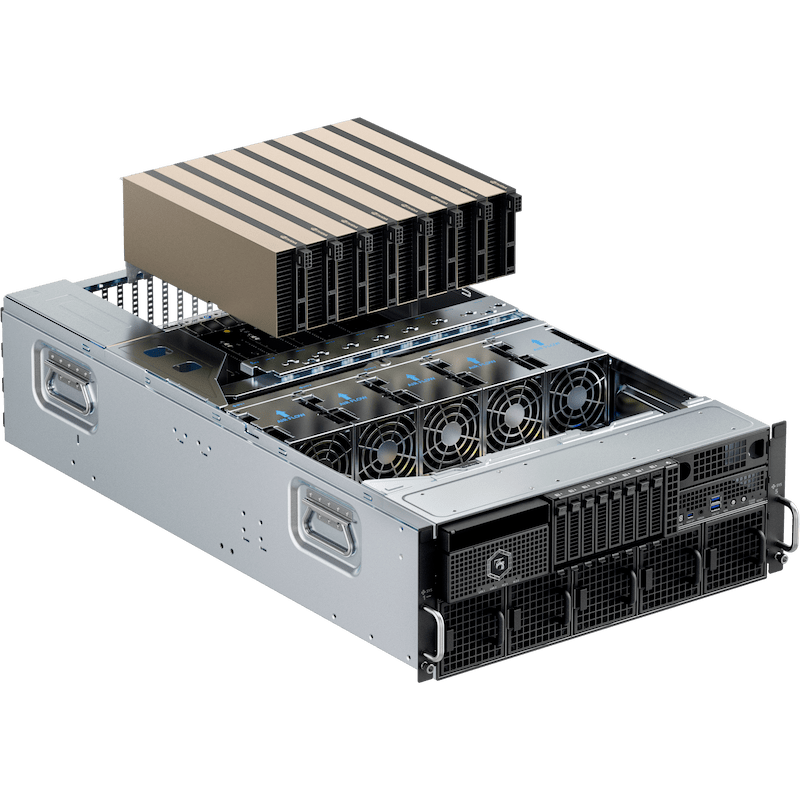

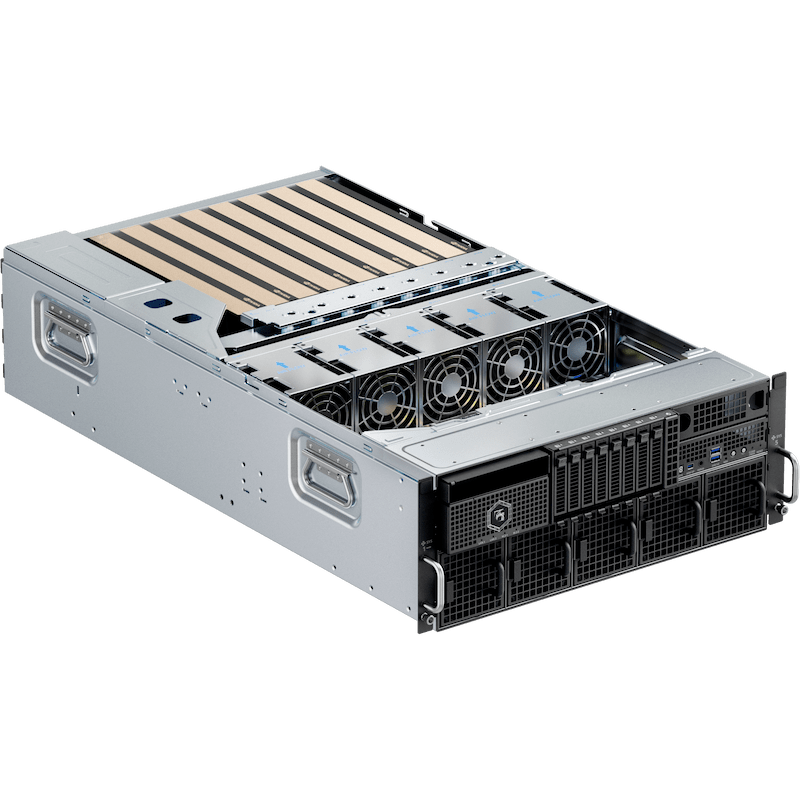

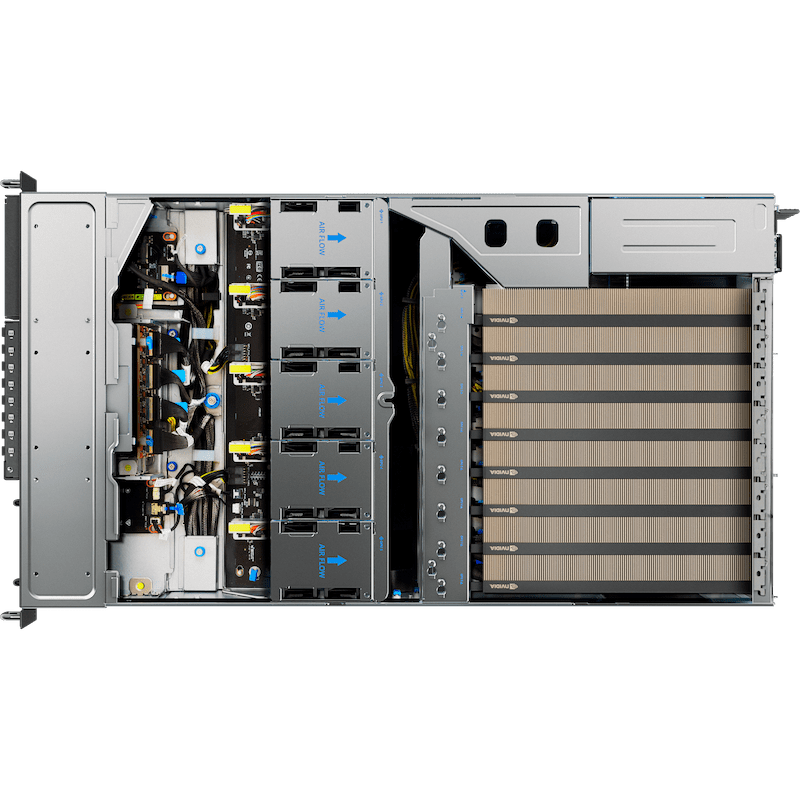

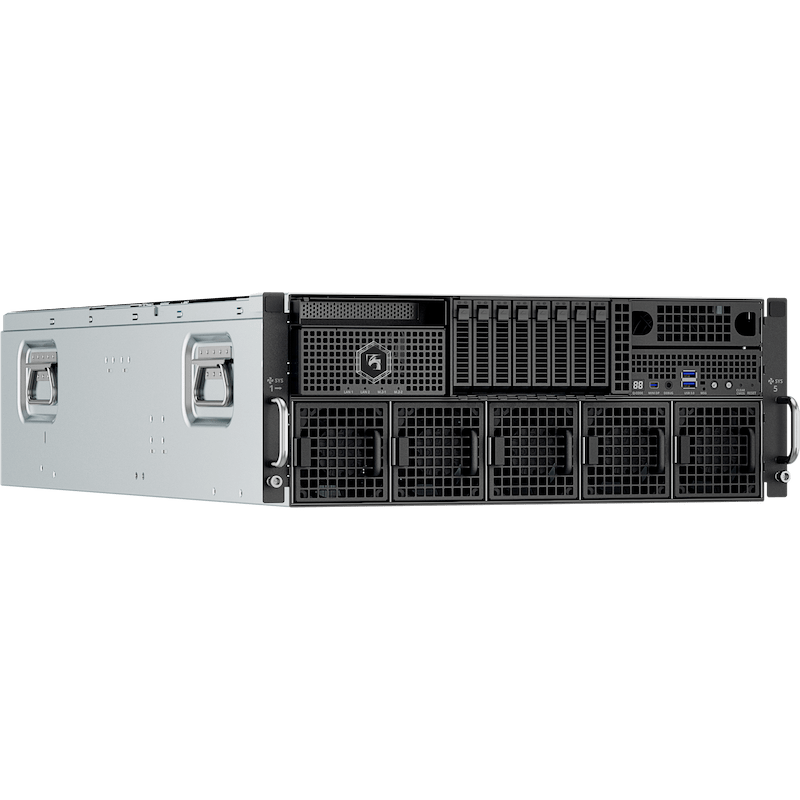

HPC 8000

Серия серверов для кластеризации на 8 GPU. Предназначены для дата-центров и AI-ферм, где требуется повышенная плотность для обучение LLM и R&D.

Процессоры

Количество ядер

Видеокарты

Количество видеокарт

Оперативная память

Размеры

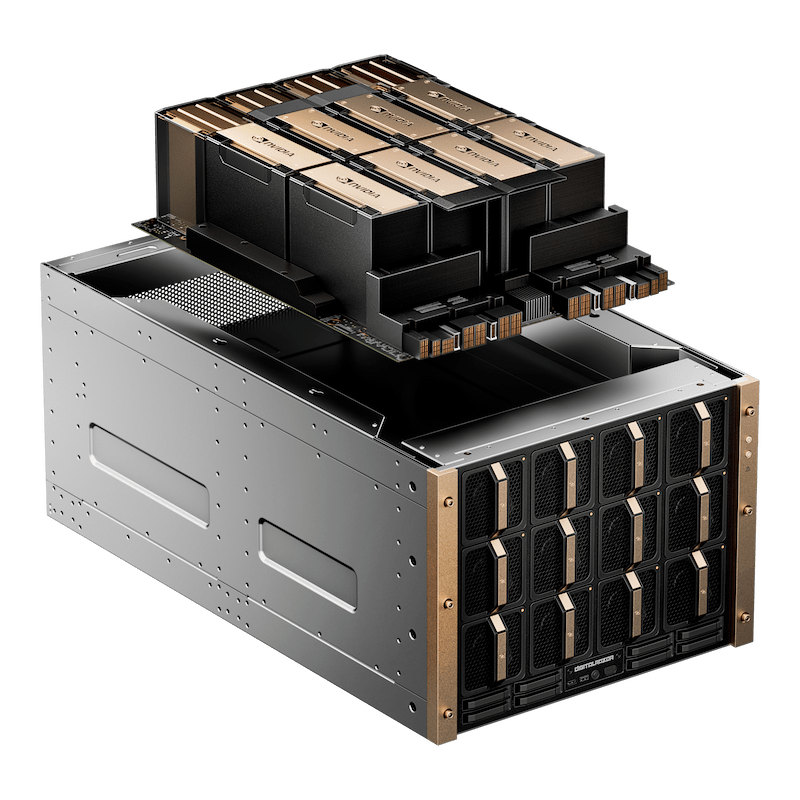

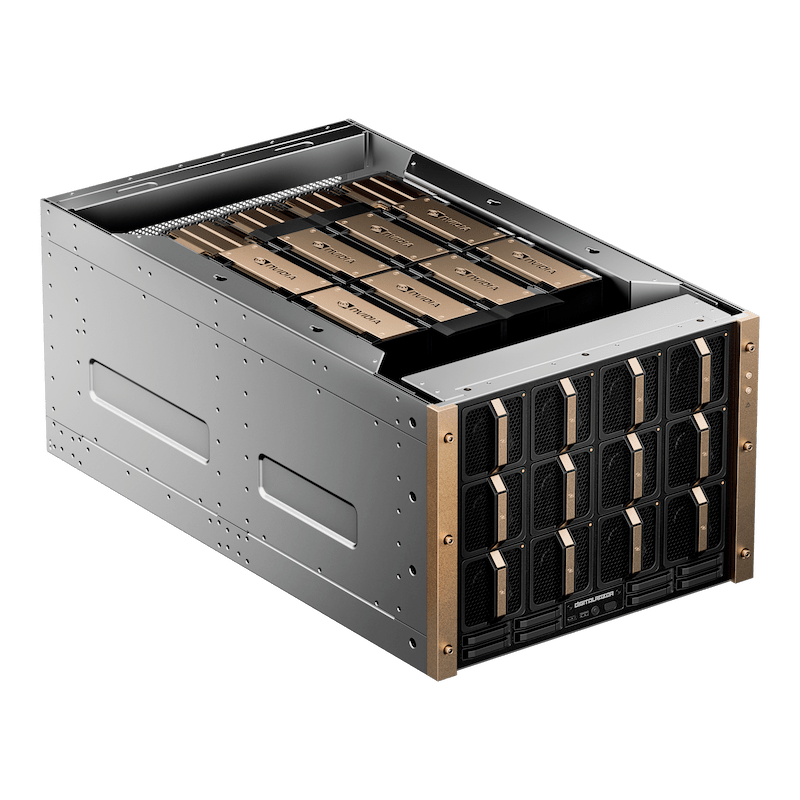

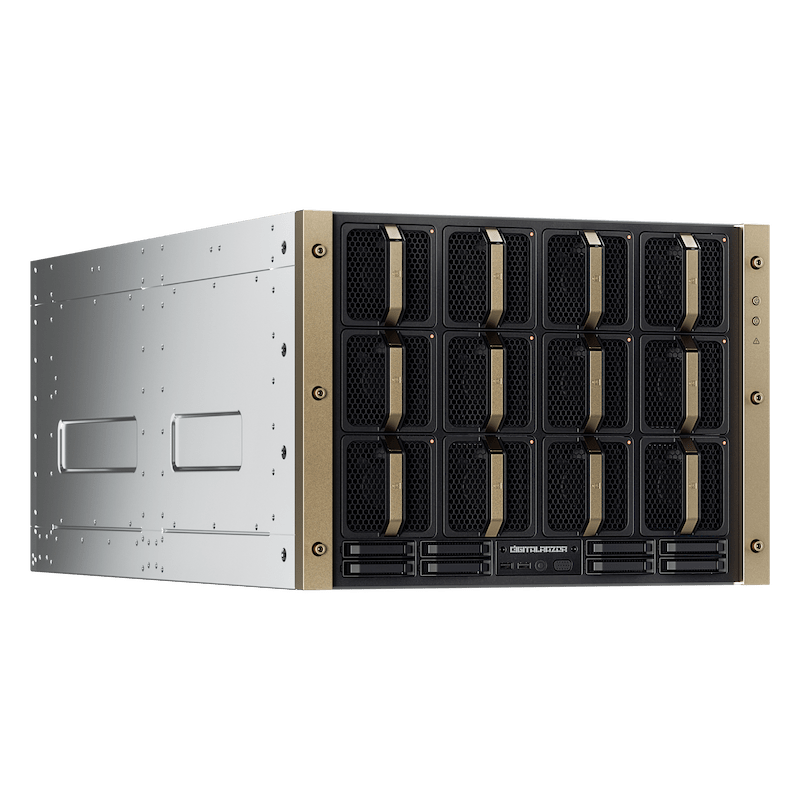

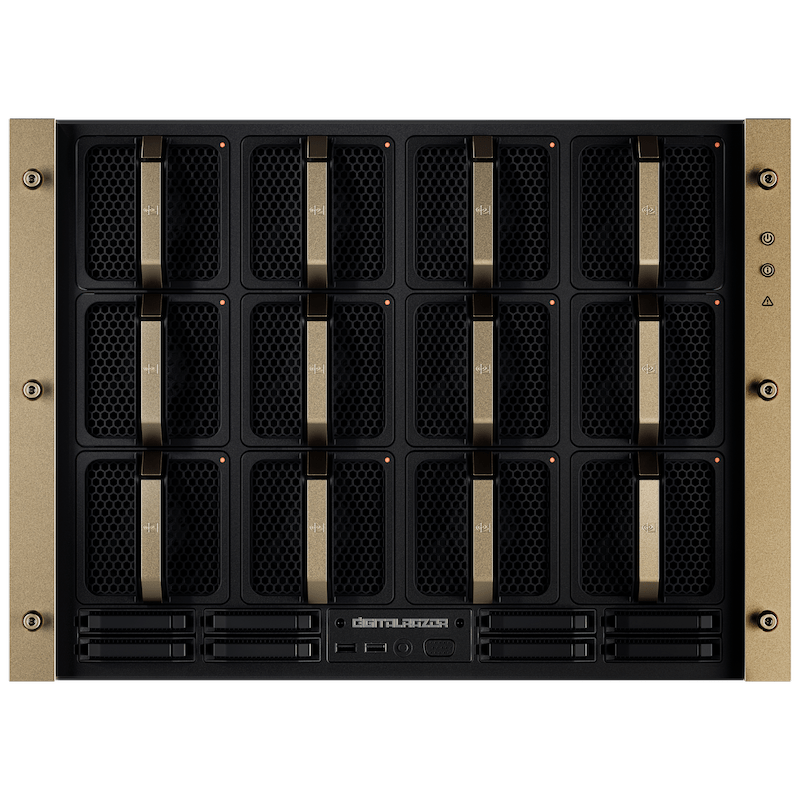

HGX H200

HGX объединяет 8 видеокарт NVIDIA H200, достигая экстремальной плотности производительности. Благодаря внутренней связности NVSwitch мгновенно интегрируется в масштабные вычислительные кластеры.

Процессоры

Количество ядер

Видеокарты

Количество видеокарт

Оперативная память

Размеры

Начните с тестирования

Вы можете протестировать системы перед покупкой и подобрать подходящую конфигурацию. Доступны варианты из наличия для быстрой отгрузки.

Почему важно запускать ИИ локально

Защита данных

Данные остаются внутри инфраструктуры, что важно для финансового, юридического и медицинского сектора.

Минимальные задержки

Быстрый отклик и стабильная работа даже без доступа к интернету.

Экономия

После первоначальных затрат эксплуатация дешевле, чем при использовании облачных API.

Контроль и гибкость

Возможность дообучать модель, адаптировать под свои данные и процессы.

Сценарии применения LLaMA

Решения DigitalRazor на базе LLaMA 3 и LLaMA 4 подходят для задач, где особенно важны автономность, контроль над данными и стабильная работа в собственной инфраструктуре. Мы подбираем готовые рабочие станции и серверы под реальные сценарии локального запуска LLM без зависимости от облачных сервисов и внешних API.

-

Виртуальные корпоративные ассистенты

Автоматизация взаимодействия с сотрудниками и клиентами: ответы на вопросы, помощь в работе с внутренними системами, проведение инструктажей — без передачи данных в облако.

-

Обработка и анализ документов

Извлечение информации из договоров, заявок и отчётов, классификация документов, формирование сводок и автоматическая подготовка ответов.

-

Генерация аналитики и прогнозов

Подготовка аналитических отчётов, моделирование бизнес-сценариев, прогнозирование спроса и оценка рисков на основе внутренних данных.

-

Рекомендательные системы

Персонализированные подборки товаров, материалов или контента для клиентов и сотрудников, построенные на собственных корпоративных данных.

-

Автоматизация рабочих процессов

Создание скриптов и инструментов для автоматизации задач: проверка заявок, контроль качества, формирование стандартных документов и ответов.

Тестирование Llama

Оценка моделей LLaMA 3 и LLaMA 4 в задачах по программированию,

знаниям и рассуждениям.

| Бенчмарк | Llama 4 Maverick | Llama 4 Scout | Llama 3.3 70B |

|---|---|---|---|

| LiveCodeBench | 43.4% | 32.8% | 33.3% |

| MMLU Pro | 80.5% | 74.3% | 68.9% |

| GPQA Diamond | 69.8% | 57.2% | 50.5% |

Почему выбирают DigitalRazor

Мы создаём готовые решения для LLaMA 3 и LLaMA 4, где каждый элемент — от компонентов до сборки и поддержки — продуман под ваши задачи. Это надёжность, простота и технологическая мощь в одном.

Комплектация и настройка под ключ

Рабочие станции поставляются полностью готовыми к работе: установлены все драйверы, CUDA и среда под Llama. Вам не нужно тратить время на настройку — просто включите и приступайте к проектам.

Максимальная производительность

Мы подбираем NVIDIA GPU с большим объёмом VRAM и оптимизируем систему под LLM-нагрузки. Это обеспечивает плавный отклик, стабильную работу и возможность обработки огромных контекстов.

Конфиденциальность данных

Все вычисления происходят локально — без облака и API. Полный контроль над данными и соответствие корпоративным стандартам безопасности.

Расширяемость под задачи

Системы легко масштабировать — добавляйте GPU или переходите на rack-формат по мере роста проектов. Инфраструктура растёт вместе с вашими идеями.

Сервис и поддержка на каждом шагу

Собственное производство, тестирование и сервисный центр: мы сопровождаем вашу систему от сборки до апгрейда и гарантии — всё под вашим контролем.

Наши клиенты

Мы убеждены, что компьютеры должны делать вашу работу более эффективной, и гордимся тем, что уже помогли тысячам компаний и частных лиц ускорить их деятельность.

Глобалтехэкспорт

МФТИ

Айтеко

Usetech

МЭИ

Визионеро

ФИЦ Коми научный центр УрО РАН

Консультант+Аскон

Современные системы реновации

Селигдар

ИПЭЭ РАН

Эффективные технологии

XO Studios

Сбер

Альфа-Банк

Samsung

Инновационный центр «Сколково»

Самарский университет